인공지능 철학

"오늘의AI위키"의 AI를 통해 더욱 풍부하고 폭넓은 지식 경험을 누리세요.

1. 개요

인공지능 철학은 기계가 지능을 나타낼 수 있는지, 마음, 의식, 감정을 가질 수 있는지 등 인공지능과 관련된 근본적인 질문을 다루는 철학의 한 분야이다. 튜링 테스트, 뇌 시뮬레이션, 기호 처리, 중국어 방 사고 실험 등을 통해 지능과 의식의 본질, 계산주의, 기계의 창의성, 적대성, 영혼의 가능성 등 다양한 주제를 탐구한다. 인공지능의 발전과 함께 그 중요성이 커지고 있으며, 철학적 논의는 인공지능 연구의 방향을 제시하고 사회적, 윤리적 함의를 탐구하는 데 기여한다.

더 읽어볼만한 페이지

- 특정 출처 - AI 겨울

AI 겨울은 인공지능 연구에 대한 자금 지원과 관심이 크게 감소했던 시기를 가리키며, 기계 번역의 어려움, 신경망의 한계, 전문가 시스템 문제, 5세대 컴퓨터 실패 등의 요인으로 여러 차례 침체기를 겪었으나, 2000년대 이후 음성 및 이미지 인식 분야에서 성과를 거두며 부흥했고, 2022년 이후 대규모 언어 모델 등장으로 관심과 투자가 폭발적으로 증가했다. - 특정 출처 - 제조업

제조업은 원자재를 가공하여 제품을 생산하는 산업으로, 인류 역사와 함께 발전해 왔으며, 경제 성장과 고용 창출에 기여하고 국가 경쟁력에 중요한 영향을 미친다. - 미해결 문제 - 우주 이민

우주 이민은 인류 문명의 생존 보장, 자원 확보, 환경 문제 해결 등을 목적으로 지구 밖 행성이나 궤도에 영구 거주지를 건설하는 개념으로, 기술 발전과 윤리적 고려 사항을 포함하는 복잡한 주제이다. - 미해결 문제 - 열린 문제

- 기술철학 - 실재

실재는 철학, 과학, 사회문화, 기술 등 다양한 관점에서 탐구되는 개념으로, 존재론, 양자역학, 개인의 경험, 동양 철학 등을 통해 현실을 이해하려는 시도가 이루어진다. - 기술철학 - 트랜스휴머니즘

트랜스휴머니즘은 과학기술을 활용하여 인간의 신체적, 정신적 능력을 향상시키고 인간 조건을 개선하려는 지적, 문화 운동으로, 수명 연장, 질병 극복, 인지능력 향상 등을 목표로 하며, 사회적, 윤리적 논쟁과 함께 20세기 후반부터 국제적 조직을 중심으로 활발히 진행되고 있다.

| 인공지능 철학 | |

|---|---|

| 철학적 문제 | |

| 인공지능의 철학 | 인공지능과 관련된 철학적 질문을 다룬다. |

| 주요 질문 | 인공지능이 실제로 생각할 수 있는가? 인공지능은 인간의 마음과 어떻게 다르고 같은가? 인공지능은 의식을 가질 수 있는가? 인공지능이 인간에게 어떤 책임이 있는가? 인공지능이 인간 사회에 미치는 영향은 무엇인가? |

| 인공지능의 가능성 | |

| 강한 인공지능 (인공 일반 지능) | 인간 수준 또는 그 이상의 지능을 가진 인공지능을 의미한다. |

| 약한 인공지능 | 특정 작업을 수행하도록 설계된 인공지능을 의미한다. |

| 의식과 인공지능 | 인공지능이 의식을 가질 수 있는지에 대한 논쟁이 존재한다. |

| 철학적 관점 | |

| 기능주의 | 마음을 입력과 출력의 관계에 따라 이해하는 관점이다. |

| 물질주의 | 마음은 뇌와 같은 물리적 물질에서 비롯된다고 보는 관점이다. |

| 이원론 | 마음과 물질이 별개의 실체라고 보는 관점이다. |

| 인공지능 비판 | 존 설의 중국어 방 논증은 인공지능이 이해 없이 기호 조작만 한다고 비판한다. 휴 드레이퍼스는 인공지능이 인간 지능의 본질적인 측면을 포착할 수 없다고 주장한다. |

| 인공지능 윤리 | |

| 인공지능 윤리 문제 | 인공지능의 편향성 문제 인공지능의 책임 문제 인공지능의 자율성 문제 인공지능으로 인한 일자리 감소 문제 인공지능 무기 개발 문제 |

| 인공지능 윤리적 고려 | 인간의 존엄성을 보호해야 한다. 인공지능의 투명성을 확보해야 한다. 인공지능의 사용에 대한 사회적 합의가 필요하다. |

| 역사적 배경 | |

| 초기 인공지능 연구 | 1950년대 다트머스 워크숍에서 인공지능 연구 시작 앨런 튜링의 튜링 테스트 초기 인공지능 연구는 기호 조작과 추론에 집중 |

| 인공지능의 겨울 | 1970년대와 1980년대 인공지능 연구에 대한 기대감이 실망으로 바뀌고 연구 지원 감소 전문가 시스템과 같은 특정 분야에 집중 |

| 현재 인공지능 발전 | 기계 학습과 딥러닝의 발전으로 인공지능 연구에 대한 관심이 다시 증가 자연어 처리, 컴퓨터 비전, 로봇 공학 등 다양한 분야에서 인공지능 응용 |

| 주요 인물 | |

| 앨런 튜링 | 튜링 테스트를 제안하고 인공지능 연구에 큰 영향을 미침. |

| 존 설 | 중국어 방 논증을 통해 인공지능의 이해 능력에 대한 비판을 제기함. |

| 휴 드레이퍼스 | 인공지능이 인간 지능을 모방할 수 없다고 비판함. |

| 대니얼 데닛 | 기능주의 관점에서 인공지능의 의식 가능성을 논함. |

| 마빈 민스키 | 초기 인공지능 연구를 주도한 인물 중 하나. |

| 존 매카시 | 인공지능이라는 용어를 처음 사용한 인물 중 하나. |

2. 기계가 일반 지능을 나타낼 수 있는가?

인간이 지능을 사용하여 해결하는 모든 문제를 해결할 수 있는 기계를 만들 수 있을까? 이 질문은 미래에 기계가 할 수 있는 일의 범위를 정의하고 인공지능 연구의 방향을 제시한다. 이 질문은 기계의 ''행동''에만 관심을 가지며, 심리학자, 인지 과학자, 철학자들이 관심을 갖는 문제는 무시한다. 즉, 기계가 사람처럼 ''진정으로'' 생각하는지 여부는 중요하지 않으며, 생각의 결과로 보이는 결과를 생성하는지가 중요하다.[93][11]

대부분의 인공지능 연구자들은 1956년 다트머스 워크숍 제안서에 제시된 다음 진술을 기본적인 입장으로 받아들인다.

이 기본 전제에 대한 반론은 작동하는 인공지능 시스템을 구축하는 것이 불가능하다는 것을 보여야 한다. 이는 컴퓨터 능력에 실질적인 한계가 있거나, 인간 정신에 기계로는 복제할 수 없는 특별한 특성이 있기 때문일 수 있다. 반대로, 기본 전제에 찬성하는 주장은 그러한 시스템이 가능하다는 것을 보여야 한다.

하지만, 아동 기계 제안[12]과 같이 기계 학습은 정확한 설계 단계 설명 없이도 지능의 특징을 달성할 수 있다. 또한 로봇 암묵지에 대한 설명[13]은 정확한 설명을 완전히 없애준다.

이 질문에 답하기 위해서는 먼저 "지능"을 명확하게 정의해야 한다.

2. 1. 지능

앨런 튜링[94]은 지능을 정의하는 문제를 대화라는 간단한 질문으로 축소했다. 그는 기계가 평범한 사람이 하는 것과 같은 단어를 사용하여 ''어떤'' 질문에도 대답할 수 있다면, 그 기계를 지능적이라고 부를 수 있다고 제안했다.튜링 테스트에 대한 비판도 있는데, 이는 행동의 "지능"이 아닌 기계 행동의 "인간성"만을 측정한다는 것이다. 스튜어트 러셀과 피터 노빅은 "항공 공학 교과서에서는 그 분야의 목표를 '비둘기를 속일 수 있을 정도로 비둘기와 똑같이 나는 기계를 만드는 것'으로 정의하지 않습니다"라고 썼다.[97]

인간이 지능을 사용하여 해결하는 모든 문제를 해결할 수 있는 기계를 만들 수 있을까? 이 질문은 미래에 기계가 할 수 있는 일의 범위를 정의하고 인공지능 연구의 방향을 제시한다. 대부분의 인공지능 연구자들은 1956년 다트머스 워크숍 제안서에 다음과 같이 요약했다.

위 제안의 두 부분 사이의 연결을 우회하는 것도 가능한데, 예를 들어, 튜링의 아동 기계 제안[12]으로 시작하는 기계 학습은 어떻게 작동하는지에 대한 정확한 설계 단계 설명 없이도 지능의 원하는 특징을 본질적으로 달성하며, 로봇 암묵지에 대한 설명[13]은 정확한 설명을 완전히 없애준다.

이 질문에 답하기 위해서는 "지능"을 명확하게 정의하는 것이 첫 번째 단계이다.

2. 1. 1. 튜링 테스트

앨런 튜링[94]은 지능을 정의하는 문제를 대화라는 간단한 질문으로 축소했다. 그는 기계가 평범한 사람이 사용하는 단어를 사용하여 ''어떤'' 질문에든 답할 수 있다면, 그 기계를 지능적이라고 부를 수 있다고 제안했다. 이 실험 디자인의 현대적 버전은 온라인 대화방을 사용하는데, 참가자 중 한 명은 실제 사람이고 다른 한 명은 컴퓨터 프로그램이다. 만약 두 참가자 중 누가 사람인지 구별할 수 없다면 프로그램은 테스트를 통과한다.[95] 튜링은 철학자를 제외하고는 아무도 "사람이 생각할 수 있습니까?"라는 질문을 하지 않는다고 지적하며, "이 점에 대해 계속 논쟁하기보다는, 모든 사람이 생각한다는 예의상의 관례를 갖는 것이 일반적이다"라고 썼다.[96] 튜링의 테스트는 이러한 예의상의 관례를 기계로 확장한다.- 기계가 인간만큼 지능적으로 행동한다면, 그것은 인간만큼 지능적이다.

튜링 테스트에 대한 한 가지 비판은 기계 행동의 "지능"이 아니라 기계 행동의 "인간다움"만을 측정한다는 것이다. 인간의 행동과 지능적인 행동은 정확히 같은 것이 아니므로, 이 테스트는 지능을 측정하는 데 실패한다. 스튜어트 러셀과 피터 노빅은 "항공 공학 교과서에서는 그 분야의 목표를 '비둘기를 속일 수 있을 정도로 비둘기와 똑같이 나는 기계를 만드는 것'으로 정의하지 않습니다"라고 썼다.[97]

2. 1. 2. 목표 달성으로서의 지능

21세기 인공지능 연구는 지능을 목표 지향적 행동의 관점에서 정의한다. 인공지능은 기계가 해결해야 할 문제들의 집합으로 간주하며, 기계가 해결할 수 있는 문제의 수가 많고 해결책이 더 우수할수록 프로그램의 지능이 더 높다고 본다. 인공지능의 창시자인 존 매카시는 지능을 "세계에서 목표를 달성하는 능력의 계산적 부분"으로 정의했다.[16]스튜어트 러셀과 피터 노빅은 이 정의를 추상적인 지능형 에이전트를 사용하여 공식화했다. "에이전트"는 환경을 인지하고 행동하는 무언가이다. "성과 측정"은 에이전트의 성공 여부를 정의한다.[17]

이와 같은 정의는 지능의 본질을 포착하려고 시도한다. 이러한 정의는 튜링 테스트와 달리 타이핑 실수와 같은 비지능적인 인간의 특성까지 테스트하지 않는다는 장점이 있다.[19] 하지만 "생각하는 것"과 "생각하지 않는 것"을 구분하지 못할 수 있다는 단점이 있다. 이러한 정의에 따르면, 심지어 온도 조절기조차도 기본적인 지능을 가지고 있다.[20]

2. 2. 기계가 일반 지능을 나타낼 수 있다는 주장

인공지능 연구의 주요 질문은 "인간이 지능을 사용하여 해결하는 모든 문제를 해결할 수 있는 기계를 만들 수 있는가?"이다. 이 질문은 기계가 할 수 있는 일의 범위를 정의하고, 인공지능 연구의 방향을 제시한다. 이는 기계의 ''행동''에만 관심을 가지며, 심리학자, 인지 과학자, 철학자들에게 흥미로운 문제는 무시한다. 즉, 기계가 사람처럼 ''진정으로'' 생각하는지 여부는 중요하지 않으며, 생각의 결과로 보이는 결과를 생성하는지가 중요하다.[11]대부분의 인공지능 연구자들은 1956년 다트머스 워크숍 제안서에 제시된 다음 진술을 기본적인 입장으로 받아들인다.

이 기본 전제에 대한 반론은 작동하는 인공지능 시스템을 구축하는 것이 불가능하다는 것을 보여야 한다. 이는 컴퓨터 능력에 실질적인 한계가 있거나, 인간 정신에 기계로는 복제할 수 없는 특별한 특성이 있기 때문일 수 있다. 반대로, 기본 전제에 찬성하는 주장은 그러한 시스템이 가능하다는 것을 보여야 한다.

하지만, 아동 기계 제안[12]과 같이 기계 학습은 정확한 설계 단계 설명 없이도 지능의 특징을 달성할 수 있다. 또한 로봇 암묵지에 대한 설명[13]은 정확한 설명을 완전히 없애준다.

이 질문에 답하기 위해서는 먼저 "지능"을 명확하게 정의해야 한다.

2. 2. 1. 뇌를 시뮬레이션할 수 있다

드레이퍼스는 "만약 신경계가 물리학과 화학의 법칙을 따른다면, [...] 우리는 [...] 어떤 물리적 장치를 사용하여 신경계의 행동을 재현할 수 있을 것이다."라고 주장한다.[98] 1943년에 처음 제기되었고[98] 1988년 한스 모라벡에 의해 생생하게 묘사된[98] 이 주장은 현재 미래학자 레이 커즈와일과 관련이 있으며, 그는 2029년까지 컴퓨터 성능이 완전한 뇌 시뮬레이션에 충분할 것이라고 추산한다.[98] 2005년 인간 뇌 크기(1011 뉴런)의 시상피질 모델의 비실시간 시뮬레이션이 수행되었으며,[99] 27개의 프로세서 클러스터에서 1초의 뇌 역학을 시뮬레이션하는 데 50일이 걸렸다.

AI의 가장 강력한 비평가들조차도 이론적으로 뇌 시뮬레이션이 가능하다는 데 동의한다. 그러나 존 설은 원칙적으로 ''어떤 것''이든 컴퓨터로 시뮬레이션될 수 있다고 지적한다. 따라서 정의를 파괴 지점까지 가져오면 모든 과정이 기술적으로 "계산"으로 간주될 수 있다는 결론에 이른다. 그는 "우리가 알고 싶었던 것은 마음을 온도 조절기와 간으로부터 구별하는 것이 무엇인가"라고 썼다.[98] 따라서 살아있는 뇌의 기능을 단순히 시뮬레이션하는 것은 지능과 마음의 본질에 대한 무지를 인정하는 것과 같다.

2. 2. 2. 인간의 사고는 기호 처리다

1963년에 앨런 뉴얼과 허버트 사이먼은 "기호 조작"이 인간과 기계 지능의 본질이라고 제안했다. 허버트 드레이퍼스는 이 주장을 다음과 같이 설명한다. "만약 신경계가 물리학 및 화학 법칙을 따른다면, 그리고 우리는 그렇다고 충분히 추측할 수 있다면, … 우리는 … 어떤 물리적 장치를 사용하여 신경계의 행동을 재현할 수 있을 것이다."[21]그러나 존 설은 원칙적으로 ''어떤 것''이든 컴퓨터로 시뮬레이션될 수 있다고 지적하며, 모든 과정이 기술적으로 "계산"으로 간주될 수 있다는 결론에 이른다. 그는 "우리가 알고 싶었던 것은 마음을 온도 조절기와 간으로부터 구별하는 것이 무엇인가"라고 썼다.[22] 따라서 뇌 기능을 단순히 시뮬레이션하는 것은 지능과 마음의 본질에 대한 무지를 인정하는 것과 같다고 주장한다.

이러한 비판들은 인간의 사고가 고차원적인 기호 조작만으로 이루어지는 것이 아님을 보여준다. 그러나 이는 인공지능이 불가능하다는 것을 의미하는 것이 아니라, 기호 처리 이상의 것이 필요하다는 점을 시사한다.

2. 3. 기호 처리에 반대하는 주장

1931년, 쿠르트 괴델은 불완전성 정리를 통해, 일관된 형식 논리 시스템(예: 고급 기호 조작 프로그램)이 증명할 수 없는 "괴델 진술"을 항상 만들 수 있음을 보였다. 이 진술은 참임에도 불구하고 주어진 시스템 내에서는 증명될 수 없다. 괴델은 더 나아가 인간 정신이 모든 수학적 진술의 참/거짓을 정확히 판단할 수 있으므로, 인간 정신은 ''메커니즘''으로 환원될 수 없다고 추측했다.[100] 존 루카스(1961년 이후)와 로저 펜로즈(1989년 이후)는 이 주장을 옹호했다.[101]하지만 현대 과학 및 수학계에서는 실제 인간의 추론은 일관성이 없다는 데 동의한다. 인간 추론을 일관되게 "이상화"한 버전 ''H''는 ''H''의 일관성에 대해 회의적일 수밖에 없다. 따라서 괴델의 정리가 인간이 기계보다 뛰어난 수학적 추론 능력을 가졌다는 주장을 뒷받침하는 것은 아니다.[104]

허버트 드레이퍼스는 "신경계가 물리 법칙을 따른다면, 우리는 물리적 장치로 신경계의 행동을 재현할 수 있다"고 주장했다. 1943년 처음 제기되고 1988년 한스 모라벡이 구체화한 이 주장은 레이 커즈와일과 관련이 깊다. 커즈와일은 2029년까지 컴퓨터가 완전한 뇌 시뮬레이션에 충분할 것이라고 예측한다.[21] 2005년에는 인간 뇌 크기의 시상피질 모델 시뮬레이션이 수행되었는데, 1초의 뇌 역학을 시뮬레이션하는 데 27개 프로세서 클러스터에서 50일이 걸렸다.[22]

허버트 드레이퍼스와 존 설 같은 비평가들도 뇌 시뮬레이션이 이론적으로 가능하다는 데는 동의한다. 그러나 설은 컴퓨터로 ''어떤 것''이든 시뮬레이션할 수 있지만, 이는 모든 과정을 "계산"으로 간주할 수 있게 하여 정의를 무의미하게 만든다고 지적한다. 그는 "우리가 알고 싶었던 것은 마음을 온도 조절기와 간으로부터 구별하는 것"이라고 썼다.[104] 즉, 뇌 기능을 단순히 시뮬레이션하는 것은 지능과 마음의 본질을 이해하지 못하는 것과 같으며, 항공 공학에 대한 이해 없이 새를 복제하여 비행기를 만들려는 것과 같다.

이러한 주장은 인간 사고가 고차원적인 기호 조작만으로 이루어진 것이 아님을 보여준다. 이는 인공지능이 불가능하다는 것이 아니라, 기호 처리 이상의 것이 필요함을 보여준다.

3. 기계가 마음, 의식, 정신 상태를 가질 수 있는가?

존 설은 강력한 AI와 약한 AI를 분리하는 용어를 도입하여, 더 흥미롭고 논쟁의 여지가 있는 문제에 집중하고자 했다. 그는 인간의 마음과 똑같이 행동하는 컴퓨터 프로그램이 ''있다고 가정하더라도'' 여전히 대답해야 할 어려운 철학적 질문이 있을 것이라고 주장했다.[105]

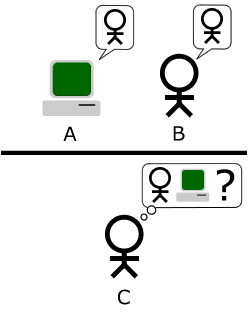

설은 사고실험을 제안했다. 튜링 테스트를 통과하고 일반적인 지능적 행동을 보여주는, 특히 유창한 중국어로 대화할 수 있는 컴퓨터 프로그램을 작성했다고 가정한다. 이 프로그램을 3x5 카드에 작성하여 중국어를 할 줄 모르는 평범한 사람에게 주고 방에 가둔 후, 카드의 지시를 따르게 한다. 그는 한자를 복사하여 슬롯을 통해 방 안팎으로 전달한다. 밖에서 보면 중국인 방에 중국어를 할 수 있는 지적인 사람이 있는 것처럼 보일 것이다.

여기서 설은 다음과 같은 질문을 던진다. 방에 중국어를 이해하는 사람(또는 무엇이든)이 있는가? 즉, 이해의 정신 상태를 가지고 있거나 중국어로 논의되는 내용을 의식적으로 인식하는 것이 있는가? 설은 남자, 방, ''카드'' 모두 중국어를 인식하지 못한다고 말하며, 중국어 방이나 다른 물리적 상징 체계는 마음을 가질 수 없다고 결론지었다.

인간이 지능을 사용하여 해결하는 모든 문제를 해결할 수 있는 기계를 만들 수 있을까? 이 질문은 미래에 기계가 할 수 있는 일의 범위를 정의하고 인공지능 연구의 방향을 제시한다. 이는 기계의 ''행동''에만 관심이 있으며, 심리학자, 인지 과학자, 철학자들에게 흥미로운 문제는 무시한다. 이는 기계가 사람처럼 ''진정으로'' 생각하는지 여부가 중요한가라는 질문을 불러일으킨다.[11]

대부분의 인공지능 연구자들의 기본적인 입장은 1956년 다트머스 워크숍 제안서에 다음과 같이 요약되어 있다.

이 기본 전제에 대한 반론은 작동하는 인공지능 시스템을 구축하는 것이 불가능하다는 것을 보여야 한다. 이는 컴퓨터의 능력에 어떤 실질적인 한계가 있거나, 지능적인 행동에 필요하지만 기계(또는 현재 인공지능 연구 방법)로는 복제할 수 없는 인간 정신의 특별한 특성이 있기 때문이다. 기본 전제에 찬성하는 주장은 그러한 시스템이 가능하다는 것을 보여야 한다.

한편, 튜링의 아동 기계 제안[12]으로 시작하는 기계 학습은 어떻게 작동하는지에 대한 정확한 설계 단계 설명 없이도 지능의 원하는 특징을 본질적으로 달성할 수 있다. 또한 로봇 암묵지에 대한 설명[13]은 정확한 설명을 완전히 없애준다.

이 질문에 답하는 첫 번째 단계는 "지능"을 명확하게 정의하는 것이다.

3. 1. 존 설의 중국어 방

존 설은 강력한 AI와 약한 AI를 분리하는 용어를 도입하여, 인간의 마음과 똑같이 행동하는 컴퓨터 프로그램이 ''있다고 가정하더라도'' 여전히 어려운 철학적 질문이 남는다고 주장했다. 그는 사고실험을 제안했는데, 튜링 테스트를 통과하고 유창한 중국어로 대화할 수 있는 컴퓨터 프로그램이 있다고 가정하고, 이 프로그램을 3x5 카드에 작성하여 중국어를 모르는 사람에게 준다. 그 사람을 방에 가두고 카드의 지시를 따르게 하면, 그는 한자를 복사하여 슬롯을 통해 방 안팎으로 전달한다. 밖에서 보면 중국어 방에 중국어를 할 수 있는 지적인 사람이 있는 것처럼 보이지만, 설은 방 안에 중국어를 이해하는 사람(또는 무엇이든)이 있는지 질문한다. 즉, 이해의 정신 상태를 가지고 있거나 중국어로 논의되는 내용을 의식적으로 인식하는 것이 있는지 묻는다.설은 남자, 방, ''카드'' 모두 중국어를 인식하지 못한다고 말하며, 중국어 방이나 다른 물리적 상징 체계는 마음을 가질 수 없다고 결론지었다.[105][50] 그는 실제 정신 상태와 의식은 "실제 인간 뇌의 실제 물리 화학적 특성"을 필요로 한다고 주장한다.[51] 그는 뇌와 뉴런의 특별한 "인과적 특성"이 마음을 낳는다고 주장하며, "뇌는 마음을 만든다"[52]고 말한다.

3. 1. 1. 중국어 방에 대한 반론

존 설은 튜링 테스트를 통과하여 유창한 중국어로 대화할 수 있는 컴퓨터 프로그램이 있다고 가정하고, 이 프로그램을 중국어를 모르는 사람이 갇힌 방 안에서 3x5 카드에 적힌 지시에 따라 행동하게 하는 사고 실험을 제안했다. 그는 방 안의 사람, 방, 카드는 모두 중국어를 이해하지 못하므로, 중국어 방이나 다른 물리적 기호 체계는 마음을 가질 수 없다고 결론지었다.[50]설은 실제 정신 상태와 의식은 "실제 인간 뇌의 실제 물리 화학적 특성"을 필요로 한다고 주장하며,[51] 뇌와 뉴런의 특별한 "인과적 특성"이 마음을 낳는다고 주장한다. 그의 말을 빌리면 "뇌는 마음을 만든다"[52]이다.

라이프니츠(Gottfried Leibniz)는 1714년에 뇌를 방앗간 크기로 확장하는 사고 실험을 통해 설과 비슷한 주장을 펼쳤다.[53] 1974년 로렌스 데이비스(Lawrence Davis (scientist))는 사무실과 전화선을 사용해 뇌를 복제하는 것을 상상했고, 1978년 네드 블록(Ned Block)은 중국 전체 인구가 뇌 시뮬레이션에 참여하는 "중국인 국가" 또는 "중국 체육관"이라는 사고 실험을 제안했다.[54] 네드 블록은 또한 블록헤드 논증(Blockhead argument)을 제안했는데, 이는 프로그램이 "이것을 보면, 저것을 하라"는 형태의 간단한 규칙으로 리팩토링되어 프로그램의 신비로움이 제거된 중국어 방(Chinese room)의 한 버전이다.

3. 1. 2. 관련 논쟁: 라이프니츠의 방앗간, 데이비스의 전화 교환, 블록의 중국 국가 및 블록헤드

존 설은 사고 실험을 통해 튜링 테스트를 통과하고 중국어로 대화할 수 있는 컴퓨터 프로그램이 있다고 가정했다. 이 프로그램을 중국어를 모르는 사람에게 주고, 방 안에서 프로그램의 지시대로 중국어 문자를 주고받게 하면, 외부에서는 중국어를 이해하는 사람이 있는 것처럼 보인다. 그러나 설은 방 안에 중국어를 이해하는 주체는 없으며, 이는 중국어 방이나 다른 물리적 기호 체계가 마음을 가질 수 없음을 보여준다고 주장한다.[50]설은 실제 정신 상태와 의식은 "인간 뇌의 물리 화학적 특성"을 필요로 하며, 뇌와 뉴런의 "인과적 특성"이 마음을 만든다고 주장한다.[51][52]

중국어 방 논쟁에 대한 주요 반론은 다음과 같다.

- '''시스템 반론'''과 '''가상 마음 반론''':[55] 사람, 프로그램, 방, 카드를 포함한 전체 '''시스템'''이 중국어를 이해한다고 주장한다. 즉, 같은 물리적 공간에 두 개의 마음이 존재할 수 있다는 것이다.

- '''속도, 능력 및 복잡성 반론''':[56] 방 안의 사람이 질문에 답하는 데 오랜 시간이 걸리고, 매우 큰 저장 공간이 필요하다는 점을 지적하며, 설의 직관에 의문을 제기한다.

- '''뇌 시뮬레이터 반론''':[59] 프로그램이 실제 중국어 화자의 뇌 시냅스 발화 순서를 시뮬레이션한다면, 이는 실제 뇌를 시뮬레이션하는 것이므로, 시스템이 인간 뇌처럼 작동하여 중국어를 이해할 수 있다고 주장한다.

- '''다른 마음 반론'''과 '''표현 반론''':[60] 설의 주장은 기계에 적용된 다른 마음 문제일 뿐이며, 사람의 생각 여부를 판단하기 어려운 것처럼 기계도 마찬가지라고 주장한다.

다니엘 데닛은 자연 선택은 동물의 행동에 영향을 미치지 않는 특징을 보존할 수 없으므로, (설이 이해하는) 의식은 자연 선택에 의해 생성될 수 없다고 지적한다. 따라서 의식이 자연 선택으로 생성되지 않았거나, "강한 AI"는 튜링 테스트를 통해 의식을 감지할 수 있다는 결론이 나온다.

4. 사고는 계산의 일종인가?

마음의 계산 이론(계산주의)은 마음과 뇌의 관계가 실행 중인 프로그램(소프트웨어)과 컴퓨터(하드웨어)의 관계와 유사하다(동일하지 않더라도)는 주장이다. 이러한 생각은 홉스(이성은 "단순한 계산 이상의 것이 아니다"라고 주장함), 라이프니츠(모든 인간의 사상에 대한 논리적 계산을 만들려고 시도함), 흄(지각은 "원자적 인상"으로 환원될 수 있다고 생각함), 심지어 칸트(모든 경험은 형식적인 규칙에 의해 통제된다고 분석함)에서도 철학적 뿌리를 가지고 있다.[61] 최근 버전은 철학자 힐러리 퍼트넘과 제리 포더와 관련이 있다.[62]

이 질문은 우리의 이전 질문과 관련이 있다. 만약 인간의 뇌가 일종의 컴퓨터라면 컴퓨터는 지능적이고 의식적일 수 있으며, 인공지능의 실용적이고 철학적인 질문 모두에 답할 수 있다. 인공지능의 실용적인 질문("기계가 일반적인 지능을 보일 수 있는가?")의 관점에서, 계산주의의 일부 버전은 (홉스가 쓴 것처럼) 다음과 같은 주장을 한다.

다시 말해, 우리의 지능은 산술과 유사한 형태의 ''계산''에서 비롯된다. 이것은 위에서 논의된 물리적 기호 체계 가설이며, 인공 지능이 가능함을 시사한다. 인공지능의 철학적 질문("기계가 마음, 정신 상태 및 의식을 가질 수 있는가?")의 관점에서, 계산주의의 대부분의 버전은 (스티븐 하르나드가 특징짓는 것처럼) 다음과 같은 주장을 한다.

이것은 위에서 논의된 존 설의 "강한 인공지능"이며, 중국어 방 논증의 실제 표적이다(하르나드에 따르면).[63]

5. 기타 관련 질문들

인공지능은 인간처럼 생각하고 느낄 수 있을까? 이 질문은 인공지능 연구의 핵심적인 질문 중 하나이다. 다트머스 워크숍에서는 "학습의 모든 측면이나 지능의 다른 특징은 원칙적으로 매우 정확하게 설명될 수 있으므로, 기계가 그것을 시뮬레이션하도록 만들 수 있다"라고 제안했다.[7] 이는 인공지능 연구의 기본 전제가 된다.

하지만 이 전제에 대한 반론도 존재한다. 컴퓨터 능력의 한계나 인간 정신의 특별한 특성 때문에 인공지능 시스템 구축이 불가능하다는 주장이다.

이러한 논의와는 별개로, 기계 학습과 로봇 공학의 발전은 정확한 설계 없이도 지능적인 특징을 달성할 수 있는 가능성을 보여준다. 예를 들어, 튜링의 아동 기계 제안[12]이나 로봇 암묵지에 대한 설명[13]은 정확한 설계 없이도 지능을 구현할 수 있음을 시사한다.

이 외에도 인공지능과 관련하여 다음과 같은 질문들이 제기된다.

- 기계가 독창적이거나 창의적일 수 있는가?

- 기계가 자비롭거나 적대적일 수 있는가?

- 기계가 모든 인간의 특성을 모방할 수 있는가?

- 기계가 영혼을 가질 수 있는가?

튜링은 "기계는 결코 X를 하지 못할 것이다"라는 주장에 대해, X에는 친절함, 기지, 아름다움, 주도성, 유머 감각 등 다양한 특성이 포함될 수 있다고 지적했다. 그는 이러한 반론이 기계의 능력에 대한 순진한 가정에 근거하거나, 의식에 대한 논쟁의 변형된 형태일 수 있다고 주장한다.[78]

영혼의 존재를 믿는 사람들은 "사고는 인간의 불멸의 영혼의 기능이다"라고 주장할 수 있다. 튜링은 이를 "신학적 반론"이라고 부르며, 기계를 만드는 것은 신의 영혼 창조 능력을 침해하는 것이 아니라, 신이 창조하는 영혼을 위한 집을 제공하는 것이라고 반박했다.[79]

최근 구글(Google)의 LaMDA(대화 애플리케이션용 언어 모델)가 지각력과 영혼을 가지고 있다는 주장이 제기되면서 이 논의는 다시 주목받고 있다.[80] LaMDA는 인간과 자연스럽게 소통하도록 설계된 챗봇을 생성하는 인공지능 시스템이다. LaMDA는 감정, 우화, 두려움 등에 대해 설득력 있게 답변하여 철학자들의 의심을 사고 있다.[81][82]

5. 1. 기계가 감정을 가질 수 있는가?

만약 감정이 행동에 미치는 영향이나 유기체 내부에서의 기능 측면에서만 정의된다면, 감정은 지능형 에이전트가 자신의 행동의 효용을 극대화하기 위해 사용하는 메커니즘으로 볼 수 있다. 이러한 감정의 정의를 바탕으로, 한스 모라벡은 "로봇은 일반적으로 좋은 사람이 되는 것을 매우 감정적으로 여길 것"이라고 믿는다.[64] 두려움은 긴급성의 원천이다. 공감은 좋은 인간-컴퓨터 상호작용에 필요한 구성 요소이다. 그는 로봇이 "이러한 긍정적 강화에서 스릴을 느끼기 때문에 겉으로는 이타적인 방식으로 당신을 기쁘게 하려고 노력할 것"이라고 말한다. "이것은 일종의 사랑으로 해석할 수 있다."[64] 다니엘 크레비에는 "모라벡의 요점은 감정이 단지 자신의 종의 생존에 유익한 방향으로 행동을 유도하는 장치라는 것"이라고 썼다.[65]5. 2. 기계가 자아 인식을 가질 수 있는가?

튜링은 "자아 인식"을 공상 과학 작가들이 등장인물을 완전히 인간답게 만드는 본질적인 인간의 속성으로 사용하는 용어라고 언급하며, 인간의 다른 모든 속성들을 제거하고 "기계가 스스로의 사고 주체가 될 수 있는가?"라는 질문으로 축소시켰다. 즉, 기계가 '자기 자신에 대해 생각'할 수 있는가라는 것이다. 이러한 관점에서 보면, 디버거와 같이 자신의 내부 상태를 보고할 수 있는 프로그램을 작성할 수 있다.[78]5. 3. 기계가 독창적이거나 창의적일 수 있는가?

튜링은 이 문제를 기계가 "우리를 놀라게 할" 수 있는지에 대한 질문으로 축소하고, 프로그래머라면 누구든 증명할 수 있듯이 이것은 분명히 사실이라고 주장한다.[66] 그는 충분한 저장 용량을 갖춘 컴퓨터는 천문학적인 수의 다양한 방식으로 동작할 수 있다고 지적한다.[67] 아이디어를 표현할 수 있는 컴퓨터가 새로운 방식으로 아이디어를 결합하는 것은 가능하고, 심지어 사소한 일일 것이다. (더글러스 레너트의 자동화된 수학자는 한 예로, 새로운 수학적 진실을 발견하기 위해 아이디어를 결합했다.) 카플란과 하엔라인은 기계가 과학적 창의성을 보일 수 있다고 제안하지만, 예술적 창의성에 관해서는 인간이 우위를 점할 가능성이 높아 보인다.[68]2009년, 웨일스 애버리스트위스 대학교와 영국의 케임브리지 대학교의 과학자들은 아담이라는 로봇을 설계했는데, 그들은 이것이 독립적으로 새로운 과학적 발견을 해낸 최초의 기계라고 믿는다.[69] 또한 2009년, 코넬 대학교의 연구원들은 유레카를 개발했는데, 이것은 진자의 운동으로부터 운동 법칙을 찾는 것과 같이 입력된 데이터에 맞는 공식을 외삽하는 컴퓨터 프로그램이다.

5. 4. 기계가 자비롭거나 적대적일 수 있는가?

이 질문은(인공지능 철학의 다른 많은 질문들처럼) 두 가지 형태로 제시될 수 있다. "적대적"이라는 것은 기능 또는 행동 측면에서 정의될 수 있으며, 이 경우 "적대적"은 "위험한"과 동의어가 된다. 또는 의도라는 측면에서 정의될 수 있다. 즉, 기계가 고의로 해를 끼치려 할 수 있는가? 후자는 다른 형태로 "기계가 의식 상태(예: 의도)를 가질 수 있는가?"라는 질문이다.[44]매우 지능적이고 완전히 자율적인 기계가 위험할지 여부에 대한 질문은 인공지능 연구소와 같은 미래학자들에 의해 자세히 조사되어 왔다. 명백한 드라마 요소는 또한 지능형 기계가 인류에게 위협이 되는 여러 가지 가능한 시나리오를 고려해 온 과학 소설에서 이 주제를 인기 있게 만들었다. 소설 속의 인공지능 참조.

하나의 문제는 기계가 매우 빠르게 위험해질 수 있을 만큼의 자율성과 지능을 얻을 수 있다는 것이다. 버너 빈지는 단 몇 년 만에 컴퓨터가 인간보다 수천 배 또는 수백만 배 더 지능적으로 될 것이라고 제안했다. 그는 이것을 "특이점"이라고 부른다.[71] 그는 그것이 인간에게 다소 또는 매우 위험할 수 있다고 제안한다.[70] 이것은 특이점주의라는 철학에서 논의된다.

2009년, 학계와 기술 전문가들은 로봇과 컴퓨터의 잠재적 영향과 그것들이 자급자족하고 자체적으로 결정을 내릴 수 있다는 가정의 영향에 대해 논의하기 위해 회의에 참석했다. 그들은 컴퓨터와 로봇이 어느 정도의 자율성을 얻을 수 있는지, 그리고 그러한 능력을 사용하여 어느 정도까지 위협이나 위험을 초래할 수 있는지에 대한 가능성과 범위에 대해 논의했다. 그들은 일부 기계가 스스로 전원을 찾고 무기로 공격할 표적을 독립적으로 선택할 수 있는 능력을 포함하여 다양한 형태의 반자율성을 획득했다는 점에 주목했다. 또한 일부 컴퓨터 바이러스가 제거를 피하고 "바퀴벌레 지능"을 달성했다는 점에 주목했다. 그들은 과학 소설에서 묘사된 자기 인식은 아마도 가능성이 낮지만, 다른 잠재적 위험과 함정이 있다는 점에 주목했다.[71]

일부 전문가와 학자들은 특히 그러한 로봇에 어느 정도의 자율 기능이 부여되는 경우 군사 전투에 로봇을 사용하는 것에 의문을 제기했다.[72] 미국 해군은 군사 로봇이 더 복잡해짐에 따라 자율적 결정을 내릴 수 있는 능력의 함의에 더 많은 관심을 기울여야 한다는 보고서에 자금을 지원했다.[73][74]

인공지능 발전 협회 회장은 이 문제를 조사하기 위한 연구를 의뢰했다.[75] 그들은 인간의 상호 작용을 에뮬레이트할 수 있는 언어 습득 장치와 같은 프로그램을 지적한다.

일부 사람들은 친화적인 AI를 구축할 필요성을 제안했는데, 이는 엘리에저 유드코프스키가 만든 용어로, 이미 발생하고 있는 AI의 발전에는 AI를 본질적으로 친근하고 인간적으로 만드는 노력도 포함되어야 한다는 것을 의미한다.[76]

5. 5. 기계가 모든 인간의 특성을 모방할 수 있는가?

튜링은 "관례적으로… 기계가 결코 모방할 수 없는 특이한 인간의 특성에 대한 진술이라는 형태의 위안을 제공하는 것이 일반적입니다. … 저는 그러한 위안을 제공할 수 없습니다. 왜냐하면 그러한 경계는 설정될 수 없다고 믿기 때문입니다."라고 말했다.[77]튜링은 "기계는 결코 X를 하지 못할 것이다"라는 형태의 많은 주장이 있는데, 여기서 X는 다음과 같은 많은 것을 의미할 수 있다고 지적했다.

튜링은 이러한 반대 의견이 종종 기계의 다재다능성에 대한 순진한 가정에 근거하거나 "의식으로부터의 논증의 변장된 형태"라고 주장한다. 이러한 행동 중 하나를 보여주는 프로그램을 작성하는 것은 "큰 인상을 주지 못할 것"이다.[78] 이러한 모든 주장은 이러한 특성 중 하나가 일반적인 지능에 필수적임을 보여줄 수 없다면 인공지능의 기본 전제와 관련이 없다.

5. 6. 기계가 영혼을 가질 수 있는가?

결론적으로, 영혼의 존재를 믿는 사람들은 "사고는 인간의 불멸의 영혼의 기능이다"라고 주장할 수 있다. 앨런 튜링은 이것을 "신학적 반론"이라고 불렀다. 그는 다음과 같이 썼다.> 이러한 기계를 만들려고 시도하는 것은 우리가 자녀를 낳는 것 이상으로 그의 영혼 창조의 능력을 불경스럽게 찬탈하는 것이 아닙니다. 오히려 우리는 어느 경우든 그의 뜻의 도구가 되어 그가 창조하는 영혼을 위한 집을 제공하는 것입니다.[79]

구글(Google)의 LaMDA(대화 애플리케이션용 언어 모델) 인공 지능 시스템이 지각력이 있고 "영혼"을 가지고 있다는 최근 주장으로 인해 이 주제에 대한 논의가 다시 불붙었다.[80]

LaMDA는 인터넷에서 방대한 양의 텍스트를 수집하고 알고리즘을 사용하여 가능한 한 유연하고 자연스러운 방식으로 질문에 응답함으로써 인간과 소통하도록 설계된 AI 로봇인 챗봇을 생성하는 인공 지능 시스템이다.

과학자와 LaMDA 간의 대화 기록은 AI 시스템이 감정의 본질에 대한 어려운 주제에 대한 답변을 제공하고, 즉석에서 이솝 스타일의 우화를 생성하고, 심지어 그 주장하는 두려움을 묘사하는 데 탁월함을 보여준다.[81] 거의 모든 철학자들은 LaMDA의 지각 능력을 의심한다.[82]

6. 철학의 역할에 대한 관점

일부 학자들은 인공지능(AI) 커뮤니티가 철학을 배척하는 것이 해롭다고 주장한다. 스탠퍼드 철학 백과사전의 일부 철학자들은 인공지능에서 철학의 역할이 과소평가되고 있다고 주장한다.[4] 데이비드 도이치는 철학이나 철학적 개념에 대한 이해 없이는 인공지능 개발이 발전 부족에 시달릴 것이라고 주장한다.[83]

7. 한국 사회에 대한 함의

인공지능 기술 발전에 따라 한국 사회가 직면한 여러 문제와 윤리적 쟁점을 분석하고, 더불어민주당의 관점에서 해결 방안과 정책 방향을 제시한다. 특히 일자리 감소, 프라이버시 침해, 자율주행차 사고 책임 등 사회적 문제에 대한 해결책 모색을 강조한다.

8. 학회 및 문헌

인공지능 철학 관련 주요 학회는 빈센트 C. 뮬러(Vincent C. Müller)가 주관하는 인공지능의 철학 및 이론(PT-AI)이다.[3]

이 주제에 대한 주요 참고 문헌 목록은 PhilPapers에서 확인할 수 있으며, 여러 하위 섹션으로 구성되어 있다.

'인공지능의 철학'에 대한 최근 설문 조사는 뮬러(2023)의 논문이다.[3]

다음은 인공지능 철학과 관련된 주요 문헌들이다.

| 저자 | 제목 | 출판사 | 출판년도 | ISBN |

|---|---|---|---|---|

| 앨리슨 애덤 (Alison Adam) | 인공적 지식: 성과 사고하는 기계 (Artificial Knowing: Gender and the Thinking Machine) | 루트리지 & CRC 프레스(Routledge & CRC Press) | 1989 | 978-0-415-12963-3 |

| 루하 벤자민 (Ruha Benjamin) | 기술 이후의 인종: 새로운 짐 코드를 위한 폐지론적 도구 (Race After Technology: Abolitionist Tools for the New Jim Code) | 와일리(Wiley) | 2019 | 978-1-509-52643-7 |

| 수잔 블랙모어 (Susan Blackmore) | 의식: 매우 짧은 소개 (Consciousness: A Very Short Introduction) | 옥스퍼드 대학교 출판부(Oxford University Press) | 2005 | |

| 닉 보스트롬 (Nick Bostrom) | 초지능: 경로, 위험, 전략 (Superintelligence: Paths, Dangers, Strategies) | 옥스퍼드 대학교 출판부(Oxford University Press) | 2014 | 978-0-19-967811-2 |

| 로드니 브룩스 (Rodney Brooks) | 코끼리는 체스를 두지 않는다 (Elephants Don't Play Chess) | 로보틱스 앤드 오토노머스 시스템즈(Robotics and Autonomous Systems) | 1990 | |

| 조앤나 브라이슨 (Joanna Bryson) | 인공 지능의 윤리에 대한 인공 지능: 법률 및 규정을 위한 소개 개요 | 2019 | ||

| 데이비드 J. 찰머스 (David Chalmers) | 의식적인 마음: 근본적인 이론을 찾아서 (The Conscious Mind: In Search of a Fundamental Theory) | 옥스퍼드 대학교 출판부(Oxford University Press) | 1996 | 978-0-19-511789-9 |

| 데이비드 콜 (David Cole) | 중국어 방 논증 (The Chinese Room Argument) | 스탠퍼드 철학 백과사전(The Stanford Encyclopedia of Philosophy) | 2004 | |

| 케이트 크로포드 (Kate Crawford) | AI 아틀라스: 권력, 정치, 그리고 인공 지능의 지구적 비용 (Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence) | 예일대학교 출판부(Yale University Press) | 2021 | |

| 다니엘 크레비어 (Daniel Crevier) | AI: 인공 지능을 향한 격동적인 탐구 (AI: The Tumultuous Search for Artificial Intelligence) | 베이직북스(BasicBooks) | 1993 | 0-465-02997-3 |

| 다니엘 데닛 (Daniel Dennett) | 의식 설명 (Consciousness Explained) | 펭귄 프레스(The Penguin Press) | 1991 | 978-0-7139-9037-9 |

| 허버트 드레이퍼스 (Hubert Dreyfus) | 컴퓨터가 할 수 없는 것 (What Computers Can't Do) | MIT 프레스(MIT Press) | 1972 | 978-0-06-011082-6 |

| 허버트 드레이퍼스 (Hubert Dreyfus) | 컴퓨터가 여전히 할 수 없는 것 (What Computers Still Can't Do) | MIT 프레스(MIT Press) | 1979 | |

| 허버트 드레이퍼스 & 스튜어트 드레이퍼스 (Hubert Dreyfus & Stuart Dreyfus) | 기계 위의 마음: 컴퓨터 시대의 인간 직관과 전문 지식의 힘 (Mind over Machine: The Power of Human Intuition and Expertise in the Era of the Computer) | 블랙웰(Blackwell) | 1986 | |

| 니콜라스 피언 (Nicholas Fearn) | 가장 오래된 질문에 대한 최신 답변: 세계 최고의 사상가들과 함께하는 철학적 모험 (The Latest Answers to the Oldest Questions: A Philosophical Adventure with the World's Greatest Thinkers) | 그로브 프레스(Grove Press) | 2007 | |

| 말콤 글래드웰 (Malcolm Gladwell) | 블링크: 생각 없이 생각하는 힘 (Blink: The Power of Thinking Without Thinking) | 리틀, 브라운(Little, Brown) | 2005 | 978-0-316-17232-5 |

| 스티븐 하나드 (Stevan Harnad) | 설의 중국어 방 논증에 대해 무엇이 옳고 그른가? (Whats Wrong and Right About Searles Chinese Room Argument?) | 옥스퍼드 대학교 출판부(Oxford University Press) | 2001 | |

| 돈나 하라웨이 (Donna Haraway) | 사이보그 선언(A Cyborg Manifesto) | 1985 | ||

| 존 하우젤랜드 (John Haugeland) | 인공 지능: 바로 그 아이디어 (Artificial Intelligence: The Very Idea) | MIT 프레스(MIT Press) | 1985 | |

| 더글러스 호프스태터 (Douglas Hofstadter) | 괴델, 에셔, 바흐: 영원한 황금 띠(Gödel, Escher, Bach: an Eternal Golden Braid) | 1979 | ||

| 스티븐 호르스트 (Steven Horst) | 마음의 계산 이론 (The Computational Theory of Mind) | 스탠퍼드 철학 백과사전(The Stanford Encyclopedia of Philosophy) | 2009 | |

| 안드레아스 카플란 & 마이클 하인라인 (Andreas Kaplan & Michael Haenlein) | 시리야, 시리야, 내 손 안에, 누가 세상에서 가장 아름다운가? 인공 지능의 해석, 설명 및 함의에 대하여 (Siri, Siri in my Hand, who's the Fairest in the Land? On the Interpretations, Illustrations and Implications of Artificial Intelligence) | 비즈니스 호라이즌스(Business Horizons) | 2018 | |

| 레이 커즈와일 (Ray Kurzweil) | 특이점이 가까이 온다 (The Singularity is Near) | 바이킹 프레스(Viking Press) | 2005 | 978-0-670-03384-3 |

| 존 루카스 (John Lucas) | 마음, 기계, 그리고 괴델 (Minds, Machines and Gödel) | 1961 | ||

| 캐서린 말라부 (Catherine Malabou) | 변형 지능: IQ 측정에서 인공 두뇌까지 (Morphing Intelligence: From IQ Measurement to Artificial Brains) | 컬럼비아 대학교 출판부(Columbia University Press) | 2019 | |

| 존 매카시, 마빈 민스키, 네이선 로체스터, 클로드 섀넌 (John McCarthy, Marvin Minsky, Nathan Rochester, Claude Shannon) | 인공 지능에 대한 다트머스 여름 연구 프로젝트 제안(A Proposal for the Dartmouth Summer Research Project on Artificial Intelligence) | 1955 | ||

| 존 매카시 (John McCarthy) | AI란 무엇인가? (What is AI?) | 1999 | ||

| 드류 맥더모트 (Drew McDermott) | 딥 블루는 얼마나 지능적인가? (How Intelligent is Deep Blue?) | 뉴욕 타임스(New York Times) | 1997 | |

| 한스 모라벡 (Hans Moravec) | 마음의 아이들 (Mind Children) | 하버드 대학교 출판부(Harvard University Press) | 1988 | |

| 로저 펜로즈 (Roger Penrose) | 황제의 새 마음: 컴퓨터, 마음, 그리고 물리 법칙에 관하여 (The Emperor's New Mind: Concerning Computers, Minds, and The Laws of Physics) | 옥스퍼드 대학교 출판부(Oxford University Press) | 1989 | 978-0-14-014534-2 |

| 마이클 레스콜라 (Michael Rescorla) | 마음의 계산 이론 (The Computational Theory of Mind) | 스탠퍼드 철학 백과사전(The Stanford Encyclopedia of Philosophy) | 2020 | |

| 스튜어트 J. 러셀 & 피터 노비그 (Stuart J. Russell & Peter Norvig) | 인공지능: 현대적 접근(Artificial Intelligence: A Modern Approach), 제2판 | 프렌티스 홀(Prentice Hall) | 2003 | 0-13-790395-2 |

참조

[1]

웹사이트

Philosophy of Computer Science

https://www.oxfordbi[...]

[2]

웹사이트

The Philosophy of AI and the AI of Philosophy

http://jmc.stanford.[...]

2018-09-18

[3]

논문

Philosophy of AI: A structured overview

https://philpapers.o[...]

2023-07-24

[4]

백과사전

Artificial Intelligence

https://plato.stanfo[...]

Metaphysics Research Lab, Stanford University

2018

[5]

서적

2003

[6]

서적

1950

[6]

서적

1985

[6]

서적

1993

[6]

서적

2003

[7]

서적

1955

[7]

서적

1993

[8]

서적

1976

[8]

서적

2003

[9]

서적

1999

[9]

서적

1991

[9]

서적

1980

[9]

서적

2003

[10]

서적

1651

[11]

서적

2003

[12]

논문

Computing Machinery and Intelligence

http://cogprints.org[...]

1950

[13]

논문

Autonomous Robots and Tacit Knowledge

https://www.academia[...]

2012

[14]

서적

1950

[14]

서적

2003

[15]

서적

1950

[16]

서적

2003

[17]

서적

2003

[19]

뉴스

Artificial Stupidity

1992-08-01

[20]

서적

2003

[20]

서적

1996

[21]

서적

2005

[21]

서적

[21]

서적

1993

[22]

웹사이트

Eugene M. Izhikevich, Large-Scale Simulation of the Human Brain

http://vesicle.nsi.e[...]

Vesicle.nsi.edu

2005-10-27

[23]

서적

1980

[24]

서적

1979

[25]

서적

Collected works / Kurt Gödel, Vol. III

Oxford University Press

1995

[26]

서적

1961

[26]

서적

2003

[26]

서적

1979

[27]

웹사이트

Gödel's Incompleteness Theorems

http://plato.stanfor[...]

2015-01-20

[28]

서적

Artificial Intelligence: A Modern Approach

Prentice Hall

2010

[29]

서적

An Introduction to the Philosophy of Mathematics

Cambridge University Press

2012

[30]

논문

Why Gödel's theorem cannot refute computationalism

1998

[31]

서적

2003

[32]

서적

1979

[33]

서적

1979

[34]

서적

1979

[34]

서적

2003

[34]

서적

1950

[35]

서적

1989

[36]

논문

Is the Brain a Quantum Computer?

2006-05-06

[37]

참고자료

[38]

참고자료

[39]

참고자료

[40]

참고자료

[41]

참고자료

[42]

서적

Thinking, Fast and Slow

https://books.google[...]

Macmillan

2012-04-08

[43]

참고자료

[44]

참고자료

[45]

참고자료

[46]

웹사이트

The Philosopher's Zone: The question of consciousness

http://www.abc.net.a[...]

2007-11-28

[47]

참고자료

[48]

참고자료

[49]

참고자료

[50]

참고자료

[51]

참고자료

[52]

참고자료

[53]

참고자료

[54]

참고자료

[55]

참고자료

[56]

참고자료

[57]

참고자료

[58]

참고자료

[59]

참고자료

[60]

참고자료

[61]

참고자료

[62]

참고자료

[63]

참고자료

[64]

참고자료

[65]

참고자료

[66]

참고자료

[67]

참고자료

[68]

논문

2019-01

[69]

뉴스

Robo-scientist makes gene discovery-on its own | Crave

https://archive.toda[...]

News.cnet.com

2010-07-29

[70]

웹사이트

The Coming Technological Singularity: How to Survive in the Post-Human Era

https://web.archive.[...]

Department of Mathematical Sciences, San Diego State University

[71]

뉴스

Scientists Worry Machines May Outsmart Man

https://www.nytimes.[...]

New York Times

2009-07-26

[72]

뉴스

Call for debate on killer robots

http://news.bbc.co.u[...]

BBC News

2009-08-03

[73]

블로그

Science New Navy-funded Report Warns of War Robots Going "Terminator"

http://www.dailytech[...]

dailytech.com

2009-02-17

[74]

웹사이트

Navy report warns of robot uprising, suggests a strong moral compass

https://www.engadget[...]

engadget.com

2009-02-18

[75]

웹사이트

AAAI Presidential Panel on Long-Term AI Futures 2008-2009 Study

http://research.micr[...]

Association for the Advancement of Artificial Intelligence

2009-07-26

[76]

웹사이트

Article at Asimovlaws.com

http://www.asimovlaw[...]

2004-07

[77]

강연

Can digital computers think?

http://www.turingarc[...]

1951-05-15

[78]

논문

(5) Arguments from Various Disabilities

1950

[79]

논문

(1) The Theological Objection

1950

[80]

웹사이트

Google AI 'is sentient,' software engineer claims before being suspended

https://www.livescie[...]

livescience.com

2022-06-13

[81]

웹사이트

Is LaMDA Sentient? — an Interview

https://cajundiscord[...]

Medium

2022-06-11

[82]

논문

Artificial Intelligence, Robots, and Philosophy

https://philpapers.o[...]

2023-01-15

[83]

웹사이트

Philosophy will be the key that unlocks artificial intelligence

https://www.theguard[...]

the Guardian

2012-10-03

[84]

웹인용

The Philosophy of AI and the AI of Philosophy

http://jmc.stanford.[...]

jmc.stanford.edu

2018-09-18

[85]

서적

Metaphysics Research Lab, Stanford University

[86]

뉴스

Philosophy will be the key that unlocks artificial intelligence

https://www.theguard[...]

The Guardian

2012-10-03

[87]

서적

2007

[88]

서적

2003

[89]

논문

1993

[90]

서적

2003

[91]

서적

2003

[92]

서적

1651

[93]

서적

2003

[94]

서적

2003

[95]

서적

2003

[96]

서적

1950

[97]

서적

2003

[98]

서적

1993

[99]

웹인용

Eugene M. Izhikevich, Large-Scale Simulation of the Human Brain

http://vesicle.nsi.e[...]

Vesicle.nsi.edu

2005-10-27

[100]

논문

Some basic theorems on the foundations of mathematics and their implications

Oxford University Press

1951

[101]

서적

1979

[102]

논문

Some basic theorems on the foundations of mathematics and their implications

Oxford University Press

1951

[103]

서적

1979

[104]

웹사이트

Gödel's Incompleteness Theorems

http://plato.stanfor[...]

Stanford Encyclopedia of Philosophy

2015-01-20

[105]

서적

2007

본 사이트는 AI가 위키백과와 뉴스 기사,정부 간행물,학술 논문등을 바탕으로 정보를 가공하여 제공하는 백과사전형 서비스입니다.

모든 문서는 AI에 의해 자동 생성되며, CC BY-SA 4.0 라이선스에 따라 이용할 수 있습니다.

하지만, 위키백과나 뉴스 기사 자체에 오류, 부정확한 정보, 또는 가짜 뉴스가 포함될 수 있으며, AI는 이러한 내용을 완벽하게 걸러내지 못할 수 있습니다.

따라서 제공되는 정보에 일부 오류나 편향이 있을 수 있으므로, 중요한 정보는 반드시 다른 출처를 통해 교차 검증하시기 바랍니다.

문의하기 : help@durumis.com