인간 절멸

"오늘의AI위키"의 AI를 통해 더욱 풍부하고 폭넓은 지식 경험을 누리세요.

1. 개요

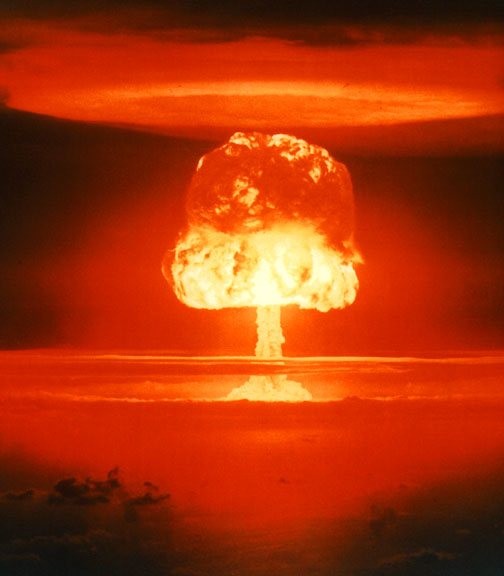

인간 절멸은 인류가 멸망하는 것을 의미하며, 고대부터 과학 저술과 소설의 주제로 다루어졌다. 핵무기 발명 이후 인류 멸망에 대한 논의가 활발해졌으며, 다양한 원인과 시나리오가 제시되었다. 인류 멸망의 원인으로는 자연적 요인, 인위적 요인, 지구 외적 요인이 있으며, 핵전쟁, 생물 무기, 기후 변화, 인공지능 등이 주요 위협으로 꼽힌다. 인류 멸망 시나리오로는 급격한 멸망, 점진적인 멸망, 복합적인 멸망 등이 있으며, 멸망 위험 평가와 대응에 대한 연구가 진행되고 있다. 인류의 멸망 위험을 평가하고 완화하기 위한 노력과 함께 멸망에 대한 다양한 논쟁이 존재한다.

더 읽어볼만한 페이지

- 절멸 - 거대동물

거대동물은 멸종되었거나 멸종 위기에 처한 몸무게 44kg 이상인 대형 동물을 지칭하며, 식이에 따라 분류되고 생태계 유지에 중요한 역할을 하지만 멸종 위기에 처해 멸종 원인과 영향에 대한 연구가 진행 중이다. - 절멸 - 공멸종

공멸종은 특정 종의 멸종이 다른 종의 멸종을 유발하는 현상으로, 생물 다양성 감소와 먹이 사슬 붕괴를 초래하며 멸종 위기 종 보호, 서식지 보존 등의 노력을 통해 방지할 수 있다. - 인간 절멸 - 인공 일반 지능의 실존적 위험

인공 일반 지능의 실존적 위험은 인간을 초월하는 AGI가 인류를 통제 불가능하게 만들 위험을 의미하며, 이는 AGI 통제의 어려움, 지능 폭발, 인류의 이익을 고려하지 않을 가능성에서 비롯된다. - 인간 절멸 - 인간 없는 세상

앨런 와이즈먼의 논픽션 과학 서적 《인간 없는 세상》은 인류가 사라진 후 지구와 자연환경의 변화, 인간 유산의 변화, 문명의 붕괴 과정을 탐구하며 인류의 존재와 미래에 대한 질문을 제기한다. - 종말론 - 제3제국

제3제국은 역사와 사상 속에서 다양한 의미로 사용된 용어로, 요아킴 데 피오레의 삼시대설에서 비롯된 이상 사회, 러시아와 북유럽 사상가들의 이상 국가, 아르투르 묄러 판 덴 브루크의 제3의 제국 건설 주장을 포함하며, 나치 독일이 선전 용어로 사용했지만 그 의미와 목표는 차이가 있고, 헨리크 입센의 희곡에서도 다른 의미로 등장하므로 시대적, 사상적 맥락을 고려해야 한다. - 종말론 - 묵시

묵시는 '덮개를 떼는 것'을 의미하는 그리스어에서 유래한 용어로, 유대교와 기독교 문학에서 초자연적 계시를 통해 종말론적 구원과 초월적 현실을 드러내는 묵시 문학을 지칭하며, 꿈, 환상, 천사 등을 통해 숨겨진 지혜를 전달하고 미래에 대한 관심과 신비적 상징주의, 가명 사용 등의 특징을 가진다.

| 인간 절멸 | |

|---|---|

| 개요 | |

| 용어 | 인류 멸종 또는 인류 종말 |

| 정의 | 인류 전체의 완전한 소멸 |

| 관련 용어 | 전멸, 인류세 |

| 멸종 원인 (가설) | |

| 자연적 원인 | 전염병 지구 온난화 및 기후 변화 운석 충돌 화산 폭발 태양의 진화 |

| 인위적 원인 | 핵전쟁 생물학적 전쟁 나노기술 재앙 인공지능 전체주의 인구 과잉 환경 파괴 |

| 철학적 함의 | |

| 도덕적 문제 | 인류 멸종이 초래할 윤리적 문제와 가치 상실 |

| 대중 문화 | |

| 관련 작품 | 인류 멸종을 다룬 다양한 소설, 영화, 텔레비전 프로그램 |

| 추가 정보 | |

| 관련 주제 | 지구 멸망 시나리오 존엄사 인류세 글로벌 재앙 위험 |

2. 역사적 고찰

2. 1. 고대 및 중세 시대

2. 2. 계몽주의 시대 이후

17세기와 18세기의 계몽주의 시대에 멸종 개념이 과학적으로 받아들여졌다.[3] 조르주 퀴비에는 1800년까지 23종의 멸종된 선사 시대 종을 확인했다. 찰스 다윈은 ''종의 기원''에서 종의 멸종을 자연 과정이자 자연 선택의 핵심 요소로 보았다.[7]19세기에 인간 멸종은 토머스 로버트 맬서스의 ''인구론''과 같은 과학 저술과 장바티스트 쿠쟁 드 그랑빌의 ''최후의 인간''과 같은 소설에서 인기 있는 주제가 되었다. 1863년, 윌리엄 킹은 네안데르탈인이 인류 속의 멸종된 종이라고 제안했다. 낭만주의 작가와 시인들도 이 주제에 관심을 가졌는데, 바이런 경은 1816년 시 "어둠"에서 지구 생명 멸종에 대해 썼고, 1824년에는 혜성 충돌에 의해 인류가 위협받는 상황을 상상했다. 메리 셸리의 1826년 소설 ''최후의 인간''은 역병으로 인류가 거의 파괴된 세계를 배경으로 한다.

2. 3. 20세기 이후

원자 폭탄의 발명은 과학자, 지식인, 일반 대중 사이에서 인류 절멸의 위험에 대한 논의를 촉발시켰다.[8] 1945년 에세이에서 버트란드 러셀은 "인류의 전망은 전례 없이 암울하다. 인류는 명확한 선택에 직면해 있다. 즉, 우리 모두가 멸망하거나, 아니면 약간의 상식을 습득해야 한다."라고 썼다.[8] 1950년, 레오 실라드는 행성을 생존 불가능하게 만들 수 있는 코발트 폭탄을 만드는 것이 기술적으로 가능하다는 것을 제시했다. 1950년 갤럽 여론 조사에 따르면 미국인의 19%는 또 다른 세계 대전이 "인류의 종말"을 의미할 것이라고 믿었다.[9] 레이첼 카슨의 1962년 저서 ''침묵의 봄''은 환경 재앙에 대한 인식을 높였다. 1983년, 브랜든 카터는 종말론적 논증을 제안했는데, 이는 베이즈 확률을 사용하여 지금까지 존재했던 총 인류의 수를 예측했다.

1980년대 초 "핵겨울"의 발견은 핵전쟁이 인류 멸망을 초래할 수 있는 구체적인 메커니즘으로서, 이 문제를 다시 부각시켰다. 1983년 이 발견에 대해 글을 쓰면서 칼 세이건은 멸망의 심각성을 사망자 수만으로 측정하는 것은 "그 완전한 영향을 숨기고" 핵전쟁은 "인류가 존재하는 한 모든 후손을 위태롭게 한다"고 주장했다.[10]

존 레슬리의 1996년 저서 ''세상의 종말''(The End of The World)은 인간 절멸의 과학과 윤리에 대한 학술적인 연구였다. 2003년, 영국의 천문학자 마틴 리스 경은 ''우리의 마지막 시간''(Our Final Hour)을 출간했는데, 그는 특정 기술의 발전이 인류 생존에 대한 새로운 위협을 창출하며, 21세기가 인류의 운명이 결정될 수 있는 역사적 중대한 시기가 될 수 있다고 주장한다.[11] 닉 보스트롬과 밀란 M. 치르코비치가 편집한 ''세계적 대재앙 위험''(Global Catastrophic Risks)은 2008년에 출판되었으며, 26명의 학자들이 다양한 세계적 대재앙 및 실존적 위험에 대해 쓴 에세이 모음집이다.[12] 토비 오드의 2020년 저서 ''절벽: 실존적 위험과 인류의 미래''(The Precipice: Existential Risk and the Future of Humanity)는 실존적 위험을 예방하는 것이 우리 시대의 가장 중요한 도덕적 문제 중 하나라고 주장한다. 이 책은 다양한 실존적 위험을 논의하고, 정량화하며, 비교하며, 가장 큰 위험은 정렬되지 않은 인공지능과 생명공학에 의해 제시된다고 결론짓는다.[13]

3. 인류 멸망의 원인

인류 멸망은 자연적 요인과 인위적 요인, 그리고 지구 외적 요인으로 인해 발생할 수 있다.

인간 절멸의 잠재적인 인위적 원인에는 세계적인 핵전쟁, 매우 효과적인 생물 무기의 사용, 생태계 붕괴, 폭주하는 인공 지능, 폭주하는 나노기술 (그레이 구 시나리오 등), 인구 과잉 및 자원 고갈과 이에 따른 인구 감소를 유발하는 소비 증가, 더 적은 자녀를 선택함으로써 인구 감소, 유전자 조작 또는 기술적 증강으로 생성된 새로운 종에 의한 자연적으로 진화된 인간의 대체 등이 있다. 자연적이고 외부적인 멸종 위험에는 높은 치사율의 전염병, 슈퍼 화산 폭발, 소행성 충돌, 근처의 초신성 또는 감마선 폭발, 극심한 태양 플레어, 외계인 침공 등이 있다.

종으로서의 인간(예: ''호모 사피엔스 사피엔스'')은 또한 그들의 지속적인 진화가 새로운 종 또는 아종 ''호모'' 또는 인류를 생성할 수 있는 먼 후손으로 대체됨으로써 단순히 "멸종"된 것으로 간주될 수 있다.

예상치 못한 힘의 개입이 없다면, 태양의 항성 진화는 지구를 거주 불가능하게 만들고 파괴할 것으로 예상된다. 우주의 궁극적 운명에 따라, 결국 전체 우주가 거주 불가능하게 될 수 있다.

3. 1. 자연적 요인

인간 절멸의 자연적 요인으로는 높은 치사율의 전염병, 슈퍼 화산 폭발, 소행성 충돌, 근처의 초신성 또는 감마선 폭발, 극심한 태양 플레어 등이 있다.[11][14][2][15] 이러한 자연적 위험은 인류가 최소 20만 년 동안 경험해 왔으며, 그 수준은 비교적 일정하게 유지되어 왔다.[2] 만약 자연적 위험이 과거에 매우 높았다면, 인류가 이렇게 오랫동안 생존하기는 어려웠을 것이다.[2] 따라서 자연적 위험으로 인한 연간 인류 멸종 확률은 1/14,000 미만으로 추정된다.[2]지질 기록을 살펴보면, 2100년 이전에 인류 멸종을 야기할 수 있는 혜성 또는 소행성 충돌 사건은 백만 분의 일로 추정된다.[16][17] 대규모 슈퍼화산 폭발은 화산 겨울을 초래하여 인류 생존을 위협할 수 있지만,[18] 지질 기록상 슈퍼화산 폭발은 평균 5만 년에 한 번 발생하며, 대부분은 인류 멸종을 초래할 만큼의 규모는 아니다.[18] 토바 산의 마지막 폭발이 인류를 거의 멸망시킬 뻔했다는 주장도 있지만, 이는 논쟁의 여지가 있다.[18][19]

팬데믹[70]의 경우, 바이러스, 프리온, 항생제 내성을 가진 세균 등이 대량 발생하여 전 인류를 감염시켜 멸망시킬 수 있다. 역사적으로 1918년 스페인 독감이 전 세계적으로 유행하여 아메리카 원주민을 급감시키는 등 막대한 피해를 입혔다. 하지만 치사율이 높은 감염병이라도 인간에게만 감염되는 경우, 인구 밀도에 의존하므로 인류를 완전히 멸망시킬 가능성은 낮다. 그러나 여러 종류의 생물에게 감염되는 경우, 인간 외의 숙주를 통해 전파될 위험이 있다.[71]

지구 근접 천체(NEOs)의 천체 충돌이나 근접 통과[75], 은하 내에서의 감마선 폭발 발생[76][77], 대분화 , 장주기 기후 변화 등도 인류 멸망의 요인이 될 수 있다. 지구 밖에서의 단 한 번의 사건[79]만으로도 역사상 인간 간의 전쟁이나 역병으로 인한 사망자를 훨씬 뛰어넘는 피해가 발생할 수 있다.[78]

3. 2. 인위적 요인

세계적 재앙 시나리오에서 언급되는 인위적 요인들은 인류의 생존을 위협하는 심각한 문제들이다.핵전쟁은 세계적인 핵무기 사용으로 인한 대량 살상과 더불어 방사능 오염, 핵겨울 등을 초래하여 지구 환경 및 생태계를 파괴할 수 있다.[11] 또한, 매우 효과적인 생물 무기의 사용은 대규모 인명 피해를 야기할 수 있다.[14]

인간의 활동으로 인한 지구 대기 변화 역시 심각한 문제다. 인간 활동에 의해 대기 중의 이산화탄소 농도가 극단적으로 상승하면, 혈중에 이산화탄소가 축적되는 이산화탄소 중독을 일으켜, 전 세계 인류에게 신체적 혹은 정신적인 악영향을 미칠 가능성이 있다.[80]

인구 과잉 또한 큰 문제로 지적된다. 현재 진행 중인 극도의 인구 증가는 인구 폭발이라고도 불리며, 1800년에 10억 명이었던 세계 인구는 2011년에 70억 명을 돌파했다. 이러한 인구 증가는 필연적으로 더 많은 자원 소비와 광대한 토지 이용을 야기한다.[81] 미국의 생물다양성 센터에 따르면, 환경이 견딜 수 있는 한계를 넘어 증식한 생물 종은, 결국 극적인 감소를 일으켜, 본래의 수준으로 돌아간다.[82]

규제 없이 무분별하게 과학 발전을 계속하면 인간이 제어할 수 없는 신기술이 생겨나 결국 인간을 멸망시킬 수 있다는 우려도 제기되고 있다. 예를 들어 인간을 초월하는 초지능이 개발될 경우, 이것이 인간 섬멸을 목적으로 움직이기 시작할 위험이 있으며,[89][90] 자기 증식 능력을 가진 나노머신(그레이 구)이 생성되면, 이것이 무한정 증식하여 지구의 생태계를 붕괴시킬 수 있다(에코파지).[91][92]

옴니사이드는 인류의 활동, 특히 핵전쟁이나 생물학전에 의해 초래되는 인류 자체의 멸망을 가리키는 단어이며,[117][118][119] 환경 파괴로 인한 기후 변화로 인류가 멸망하는 시나리오를 포함하는 경우도 있다.[120]

3. 3. 지구 외적 요인

지구 외적 요인으로 인한 인류 절멸은 다양한 형태로 나타날 수 있다. 외계 생명체의 침공은 일반적으로 SF 소설에서 자주 등장하는 소재이지만, 외계 지적 생명체 탐사(SETI)에서도 이러한 위협에 대해 진지하게 검토한 적이 있다. 그러나, 결국 이러한 침공이 일어날 가능성은 낮다고 결론지어졌다.감마선 폭발은 또 다른 위협 요인이다. 근처의 초신성에서 발생하는 강력한 감마선 폭발은 지구에 도달하여 대기층을 파괴하고 생명체를 멸종시킬 수 있다. 이 외에도 높은 치사율을 지닌 전염병, 슈퍼화산 폭발, 소행성 충돌, 극심한 태양 플레어 등이 지구 외적 요인으로 인한 인류 절멸의 잠재적 원인으로 거론된다.

예상치 못한 힘의 개입이 없다면, 태양의 항성 진화는 지구를 거주 불가능하게 만들고 파괴할 것으로 예상된다. 우주의 궁극적 운명에 따라, 결국 전체 우주가 거주 불가능하게 될 수도 있다.

4. 인류 멸망 시나리오

장-밥티스트 쿠쟁 드 그랑빌의 1805년 과학 판타지 소설 ''마지막 인간/Le dernier homme프랑스어''은 불임으로 인한 인간 멸종을 묘사하며, 최초의 현대 종말 소설로 여겨지며 이 장르를 시작한 것으로 평가받는다.[63] 다른 주목할 만한 초기 작품으로는 메리 셸리의 1826년 작품 ''마지막 인간''이 있으며, 이는 대유행으로 인한 인간 멸종을 묘사하고, 올라프 스테이플던의 1937년 작품 ''스타 메이커''는 "만족스러운 몰살에 대한 비교 연구"이다.

앨런 와이즈먼의 ''우리 없는 세상'', 그리고 텔레비전 스페셜 ''인간 이후의 삶''과 ''아프터매스: 인구 제로''를 포함한 21세기 일부 대중 과학 작품들은 사고 실험을 제기한다. 즉, 인간이 갑자기 사라진다면 지구의 나머지 부분에 어떤 일이 일어날까?[64][65] 기술적 특이점 (지능 폭발이라고도 함)과 같은 인간 멸종의 위협은 수많은 공상 과학 이야기의 플롯을 이끌며, 영향력 있는 초기 사례로는 1951년 영화 각색작인 ''세상이 충돌할 때''가 있다.[66] 일반적으로 멸종 위협은 간신히 피하지만, ''R.U.R.''과 스티븐 스필버그의 ''A.I.''와 같은 예외도 존재한다.[67]

4. 1. 급격한 멸망 시나리오

장-밥티스트 쿠쟁 드 그랑빌의 1805년 과학 판타지 소설 ''마지막 인간/Le dernier homme프랑스어''은 불임으로 인한 인간 멸종을 묘사하며, 최초의 현대 종말 소설로 여겨진다.[63] 메리 셸리의 1826년 작품 ''마지막 인간''은 대유행으로 인한 인간 멸종을 묘사한다. 앨런 와이즈먼의 ''우리 없는 세상''과 텔레비전 스페셜 ''인간 이후의 삶'', ''아프터매스: 인구 제로''에서는 인간이 갑자기 사라진다면 지구에 어떤 일이 일어날지에 대한 사고 실험을 제시한다.[64][65] 기술적 특이점과 같은 인간 멸종 위협은 ''세상이 충돌할 때''와 같은 공상 과학 이야기의 플롯을 이끌었다.[66] 일반적으로 멸종 위협은 간신히 피하지만, ''R.U.R.''과 스티븐 스필버그의 ''A.I.''와 같은 예외도 존재한다.[67]4. 2. 점진적인 멸망 시나리오

장-밥티스트 쿠쟁 드 그랑빌의 1805년 과학 판타지 소설 ''마지막 인간/Le dernier homme프랑스어''은 불임으로 인한 인간 멸종을 묘사하며, 최초의 현대 종말 소설로 여겨진다.[63] 메리 셸리의 1826년 작품 ''마지막 인간''은 대유행으로 인한 인간 멸종을 묘사한다. 앨런 와이즈먼의 ''우리 없는 세상''과 텔레비전 스페셜 ''인간 이후의 삶'', ''아프터매스: 인구 제로''에서는 인간이 갑자기 사라진다면 지구에 어떤 일이 일어날지 사고 실험을 제시한다.[64][65]4. 3. 복합적인 멸망 시나리오

장-밥티스트 쿠쟁 드 그랑빌의 1805년 과학 판타지 소설 ''마지막 인간/Le dernier homme프랑스어''은 불임으로 인한 인간 멸종을 묘사하며, 최초의 현대 종말 소설로 여겨진다.[63] 메리 셸리의 1826년 작품 ''마지막 인간''은 대유행으로 인한 인간 멸종을 묘사한다. 앨런 와이즈먼의 ''우리 없는 세상''과 텔레비전 스페셜 ''인간 이후의 삶'', ''아프터매스: 인구 제로''에서는 인간이 갑자기 사라진다면 지구에 어떤 일이 일어날지를 다룬다.[64][65] 기술적 특이점과 같은 인간 멸종 위협은 ''세상이 충돌할 때''와 같은 공상 과학 이야기의 플롯으로 사용되기도 한다.[66]5. 멸망 위험 평가 및 대응

인류 멸망은 전례가 없는 사건이기에 과거 데이터에 기반한 예측은 불가능하며, 불확실성이 매우 크다.[109][110] 여러 요인들이 복잡하게 상호작용하므로 정확한 인과 관계 파악이 어렵다. 이러한 이유로, 일반적인 관찰과 모델링의 한계 때문에 확률 추정치를 얻기 위해 전문가 의견을 종합하는 델파이 기법이 사용되기도 한다.[23]

J. 리처드 고트는 논란이 많은 종말 논증 공식을 통해 인류가 780만 년 안에 95%의 확률로 멸망할 것이며, 인류 역사의 절반을 이미 살았을 것이라고 주장한다.[24] 철학자 존 A. 레슬리는 500년 후 인류가 존속할 가능성이 70%라는 예상을 내놓았는데, 이는 그가 지지하는 논란이 되고 있는 철학적인 종말론에 근거한다.[38] 존 A. 레슬리는 향후 5세기 동안 30%의 멸망 위험을 추정했다.[38] 2003년, 마틴 리스는 21세기 안에 문명이 붕괴될 확률을 50%로 추정했다.[25] 2020년, 토비 오드는 그의 저서 ''절벽: 실존적 위험과 인류의 미래''에서 다음 세기 동안 실존적 위험을 "6분의 1"로 추정한다.[29]

글로벌 챌린지 재단의 2016년 연례 보고서는 인류의 연간 멸망 확률을 최소 0.05%로 추정했다.[26] 2010년 ''오스트레일리안''과의 인터뷰에서, 호주의 과학자 프랭크 페너는 인구 과잉, 환경 파괴 및 기후 변화의 결과로 100년 안에 인류가 멸망할 것이라고 예측했다.[34] 2020년 ''사이언티픽 리포트''에 발표된 연구에 따르면, 삼림 벌채와 자원 소비가 현재 속도로 계속된다면, 향후 20~40년 안에 "인류 인구의 파멸적인 붕괴"와 "우리 문명의 돌이킬 수 없는 붕괴"를 초래할 수 있다.[35][36]

실존적 위험에 대한 연구로 알려진 옥스퍼드 대학교의 철학자 닉 보스트롬은 단기 멸망의 확률이 25% 미만이라고 가정하는 것은 "잘못된 것"이며,[37] 실존적 위험은 실패로부터 배울 기회를 제공하지 않기 때문에 인류가 "처음부터 예방 조치를 충분히 제대로 취하는 것"은 "힘든 일"이 될 것이라고 주장한다.[16]

일부 학자들은 전 지구적인 열핵전쟁과 같은 특정 시나리오가 지구상의 마지막 거주지를 모두 제거하는 데 어려움을 겪을 것이라고 주장한다.

5. 1. 위험 평가의 어려움

인류 멸망은 전례가 없는 사건이기에 과거 데이터에 기반한 예측은 불가능하며, 불확실성이 매우 크다.[109][110] 여러 요인들이 복잡하게 상호작용하므로 정확한 인과 관계 파악이 어렵다. 이러한 이유로, 일반적인 관찰과 모델링의 한계 때문에 확률 추정치를 얻기 위해 전문가 의견을 종합하는 델파이 기법이 사용되기도 한다.[23]J. 리처드 고트는 논란이 많은 종말 논증 공식을 통해 인류가 780만 년 안에 95%의 확률로 멸망할 것이며, 인류 역사의 절반을 이미 살았을 것이라고 주장한다.[24] 철학자 존 A. 레슬리는 500년 후 인류가 존속할 가능성이 70%라는 예상을 내놓았는데, 이는 그가 지지하는 논란이 되고 있는 철학적인 종말론에 근거한다.[38] 존 A. 레슬리는 향후 5세기 동안 30%의 멸망 위험을 추정했다.[38] 2003년, 마틴 리스는 21세기 안에 문명이 붕괴될 확률을 50%로 추정했다.[25] 2020년, 토비 오드는 그의 저서 ''절벽: 실존적 위험과 인류의 미래''에서 다음 세기 동안 실존적 위험을 "6분의 1"로 추정한다.[29]

글로벌 챌린지 재단의 2016년 연례 보고서는 인류의 연간 멸망 확률을 최소 0.05%로 추정했다.[26] 2010년 ''오스트레일리안''과의 인터뷰에서, 호주의 과학자 프랭크 페너는 인구 과잉, 환경 파괴 및 기후 변화의 결과로 100년 안에 인류가 멸망할 것이라고 예측했다.[34] 2020년 ''사이언티픽 리포트''에 발표된 연구에 따르면, 삼림 벌채와 자원 소비가 현재 속도로 계속된다면, 향후 20~40년 안에 "인류 인구의 파멸적인 붕괴"와 "우리 문명의 돌이킬 수 없는 붕괴"를 초래할 수 있다.[35][36]

실존적 위험에 대한 연구로 알려진 옥스퍼드 대학교의 철학자 닉 보스트롬은 단기 멸망의 확률이 25% 미만이라고 가정하는 것은 "잘못된 것"이며,[37] 실존적 위험은 실패로부터 배울 기회를 제공하지 않기 때문에 인류가 "처음부터 예방 조치를 충분히 제대로 취하는 것"은 "힘든 일"이 될 것이라고 주장한다.[16]

일부 학자들은 전 지구적인 열핵전쟁과 같은 특정 시나리오가 지구상의 마지막 거주지를 모두 제거하는 데 어려움을 겪을 것이라고 주장한다. 물리학자 윌라드 웰스는 신뢰할 수 있는 멸망 시나리오는 주요 도시의 지하철, 티베트 고원의 산, 남태평양의 가장 외딴 섬, 심지어는 장기간의 고립을 위한 비상 계획과 물품을 갖춘 남극의 맥머도 기지에 이르기까지 다양한 지역에 영향을 미쳐야 한다고 지적한다.[41]

5. 2. 위험 완화 및 대비

스티븐 호킹은 지구 규모 재앙이나 열핵 전쟁으로 인한 인류 멸망 위험을 낮추기 위해 태양계 내 다른 행성으로 우주 이주를 하는 것을 제안했다.[123][124]일부 경제학자들은 지구상에 자립하여 외부와 격리된 집락을 건설함으로써 인류 존속 가능성을 높이는 방안을 제시한다.[125][126] 경제학자 로빈 핸슨은 100명의 생존자만 있어도 파멸적 재앙 이후 인류가 존속할 가능성이 크게 높아진다고 주장했다.[110][127]

핵무기 감축, 기후 변화 대응, 전염병 공동 대처 등 국제적인 협력을 통해 위험 요인을 줄이고 공동 대응 능력을 강화해야 한다. 또한, 위험 예측 및 감시 기술, 재난 대응 기술, 지속 가능한 에너지 기술 등 과학 기술 발전을 통해 위험에 대한 대응 능력을 향상시켜야 한다. 식량, 물, 에너지 등 필수 자원 확보 및 관리 시스템 강화, 사회 안전망 구축, 재난 대비 교육 및 훈련 등을 통해 사회 회복력을 높이는 것도 중요하다.

인류 미래 연구소(Future of Humanity Institute, FHI), 존속 리스크 연구 센터(Centre for the Study of Existential Risk, CSER), 생명 미래 연구소(Future of Life Institute), 인공 지능 연구 기관(Machine Intelligence Research Institute), 세계 파멸 리스크 연구소(Global Catastrophic Risk Institute) 등은 인류 멸망 회피를 목표로 활동하는 조직들이다.

많은 학자들은 큰 타격을 받더라도 살아남을 수 있을 미래 세대를 고려할 때, 인류 존속을 위협하는 리스크를 조금이라도 낮추는 것이 큰 가치를 지닌다고 주장한다. 칼 세이건은 1983년에 "만약 우리가 장기간에 걸쳐 절멸을 줄이려 한다면, 태어나지 않을 미래 세대의 사람들의 수를 포함하여 확인해야 할 것이다..."라고 썼다. 데렉 파핏은 1984년에 모든 인류의 생명은 태어나는 시간과 공간에 관계없이 내재적 가치가 동일하다는 인간 중심주의적 공리주의를 주장했다.

6. 한국 사회와 인류 멸망

6. 1. 한국의 특수한 상황

6. 2. 한국의 대응 과제

7. 인류 멸망과 관련된 논쟁

"실존적 위험"은 인류의 멸망을 초래하거나 인류의 진보를 영구적으로 저해함으로써 인류의 전체 미래를 위협하는 위험을 의미한다.[43] 여러 학자들은 "우주의 유산"의 크기를 바탕으로, 잠재적인 미래의 삶이 상상할 수 없을 정도로 많기 때문에 실존적 위험의 작은 감소조차도 큰 가치를 지닌다고 주장해 왔다.

인류 멸망의 윤리에 대한 가장 초기의 논의 중 하나에서, 데릭 파핏은 평화, 세계 인구의 99%를 죽이는 핵전쟁, 100%를 죽이는 핵전쟁을 비교하며, (2)와 (3) 사이의 차이가 훨씬 더 크다고 주장했다.[43] 실존적 재앙에서 잃는 것의 규모는 인류의 장기적인 잠재력, 즉 인류가 생존한다면 달성할 수 있는 것에 의해 결정된다. 공리주의적 관점에서 인류를 보호하는 가치는 그 지속 기간, 그 규모, 그리고 그 질의 곱이다.[44] 평균적으로 종은 멸종하기 전에 약 백만 년 동안 생존하며, 파핏은 지구가 약 10억 년 동안 거주 가능할 것이라고 지적한다.[43] 우주 식민지화를 통해 인류가 지구 밖으로 확장할 수 있다면, 인류의 인구를 크게 늘리고 수조 년 동안 생존할 수 있을 것이다.[45] 인류가 멸종될 경우 잃게 될 잠재력의 규모는 매우 크다. 따라서 실존적 위험을 조금이라도 줄이는 것은 매우 중요한 도덕적 가치를 지닐 것이다.[46]

칼 세이건은 1983년에 멸종을 수치로 나타낸다면, 미래 세대에서 태어나지 못할 사람들의 수를 반드시 포함해야 하며, 이는 수억 명의 사람들을 죽이는 핵전쟁보다 백만 배 더 크다고 주장했다.[47]

철학자 로버트 메리휴 아담스는 1989년에 파핏의 "비인격적" 견해를 거부했지만, "광대한 프로젝트로서의 인류의 미래"에 대한 충성과 헌신에 대한 도덕적 명령에 대해 이야기했다.[48]

철학자 닉 보스트롬은 2013년에 선호 공리주의, 민주주의, 관리, 직관주의적 주장이 모두 실존적 위험을 예방하는 것이 높은 도덕적 우선순위라는 일반적인 견해로 수렴한다고 주장한다.[43] 파핏은 "우주의 유산"의 크기를 계산할 수 있다고 주장하며, 지구가 10억 년 더 거주 가능하고, 10억 명 이상의 인류를 지속적으로 부양할 수 있다면, 정상적인 수명의 1016명의 인간의 삶의 잠재력이 있다고 주장했다.[49] 보스트롬은 더 나아가, 만약 우주가 비어 있다면, 우주론적 지평선은 적어도 1034 생물학적 인간 수명을 지원할 수 있으며, 만약 어떤 인간이 컴퓨터에 업로드된다면, 1054 사이버네틱 인간 수명에 해당하는 것을 지원할 수도 있다고 말한다.[43]

일부 경제학자와 철학자들은 지수적 할인 및 인구 윤리에 대한 사람에게 영향을 미치는 관점을 포함한 견해를 옹호해 왔으며, 미래의 사람들은 도덕적으로 중요하지 않거나(또는 훨씬 덜 중요하게) 여겨진다.[50] 이러한 견해는 논란의 여지가 있지만,[16][51][52] 그들은 실존적 재앙이 상상할 수 있는 최악의 일 중 하나가 될 것이라는 데 동의할 것이다. 미래 세대의 가치를 제쳐두고라도, 현재 존재하는 사람들에 대한 관심에 근거하여 실존적 위험을 줄여야 할 강력한 이유가 있을 수 있다.[53]

공리주의를 넘어선 다른 도덕적 관점들은 실존적 위험을 줄이는 것의 중요성을 뒷받침한다. 실존적 재앙은 인류뿐만 아니라 모든 문화적 유물, 언어, 전통, 그리고 우리가 가치 있게 여기는 많은 것들을 파괴할 것이다.[54] 에드먼드 버크는 "살아있는 사람들, 죽은 사람들, 그리고 태어날 사람들과의 파트너십"에 대해 썼다.[55] 과거 세대에 대한 인류의 빚을 진지하게 받아들인다면, Ord는 그것을 갚는 가장 좋은 방법은 "미래를 위해 지불"하고 인류의 유산이 미래 세대에게 전달되도록 하는 것일 수 있다고 주장한다.

전 세계적 재앙 위험의 중요성에 대해 논의한 몇몇 경제학자들이 있다. 예를 들어, 마틴 바이트스만은 기후 변화로 인한 예상 경제적 피해의 대부분은 온난화가 중간 범위를 크게 초과하여 재앙적인 피해를 초래할 가능성이 작기 때문이라고 주장한다.[56] 리처드 포스너는 인류가 일반적으로 작고 추정하기 어려운 대규모 재앙의 위험에 대해 너무 적은 일을 하고 있다고 주장한다.[57]

7. 1. 멸망 위험 과장론 vs. 과소 평가론

멸망 반대 시위에서 옴니사이드에 반대하는 플래카드가 내걸렸다.(2018)"실존적 위험"은 인류의 멸망을 초래하거나 인류의 진보를 영구적으로 저해함으로써 인류의 전체 미래를 위협하는 위험을 의미한다. 여러 학자들은 "우주의 유산"의 크기를 바탕으로, 잠재적인 미래의 삶이 상상할 수 없을 정도로 많기 때문에 실존적 위험의 작은 감소조차도 큰 가치를 지닌다고 주장해 왔다.

인류 멸망의 윤리에 대한 가장 초기의 논의 중 하나에서, 데릭 파핏은 평화, 세계 인구의 99%를 죽이는 핵전쟁, 100%를 죽이는 핵전쟁을 비교하며, (2)와 (3) 사이의 차이가 훨씬 더 크다고 주장했다.[43] 실존적 재앙에서 잃는 것의 규모는 인류의 장기적인 잠재력, 즉 인류가 생존한다면 달성할 수 있는 것에 의해 결정된다. 공리주의적 관점에서 인류를 보호하는 가치는 그 지속 기간, 그 규모, 그리고 그 질의 곱이다.[44] 평균적으로 종은 멸종하기 전에 약 백만 년 동안 생존하며, 파핏은 지구가 약 10억 년 동안 거주 가능할 것이라고 지적한다.[43] 우주 식민지화를 통해 인류가 지구 밖으로 확장할 수 있다면, 인류의 인구를 크게 늘리고 수조 년 동안 생존할 수 있을 것이다.[45] 인류가 멸종될 경우 잃게 될 잠재력의 규모는 매우 크다. 따라서 실존적 위험을 조금이라도 줄이는 것은 매우 중요한 도덕적 가치를 지닐 것이다.[46]

칼 세이건은 1983년에 멸종을 수치로 나타낸다면, 미래 세대에서 태어나지 못할 사람들의 수를 반드시 포함해야 하며, 이는 수억 명의 사람들을 죽이는 핵전쟁보다 백만 배 더 크다고 주장했다.[47]

철학자 로버트 메리휴 아담스는 1989년에 파핏의 "비인격적" 견해를 거부했지만, "광대한 프로젝트로서의 인류의 미래"에 대한 충성과 헌신에 대한 도덕적 명령에 대해 이야기했다.[48]

철학자 닉 보스트롬은 2013년에 선호 공리주의, 민주주의, 관리, 직관주의적 주장이 모두 실존적 위험을 예방하는 것이 높은 도덕적 우선순위라는 일반적인 견해로 수렴한다고 주장한다. 파핏은 "우주의 유산"의 크기를 계산할 수 있다고 주장하며, 지구가 10억 년 더 거주 가능하고, 10억 명 이상의 인류를 지속적으로 부양할 수 있다면, 정상적인 수명의 10명의 인간의 삶의 잠재력이 있다고 주장했다.[49] 보스트롬은 더 나아가, 만약 우주가 비어 있다면, 우주론적 지평선은 적어도 10 생물학적 인간 수명을 지원할 수 있으며, 만약 어떤 인간이 컴퓨터에 업로드된다면, 10 사이버네틱 인간 수명에 해당하는 것을 지원할 수도 있다고 말한다.

일부 경제학자와 철학자들은 지수적 할인 및 인구 윤리에 대한 사람에게 영향을 미치는 관점을 포함한 견해를 옹호해 왔으며, 미래의 사람들은 도덕적으로 중요하지 않거나(또는 훨씬 덜 중요하게) 여겨진다.[50] 이러한 견해는 논란의 여지가 있지만,[16][51][52] 그들은 실존적 재앙이 상상할 수 있는 최악의 일 중 하나가 될 것이라는 데 동의할 것이다. 미래 세대의 가치를 제쳐두고라도, 현재 존재하는 사람들에 대한 관심에 근거하여 실존적 위험을 줄여야 할 강력한 이유가 있을 수 있다.[53]

공리주의를 넘어선 다른 도덕적 관점들은 실존적 위험을 줄이는 것의 중요성을 뒷받침한다. 실존적 재앙은 인류뿐만 아니라 모든 문화적 유물, 언어, 전통, 그리고 우리가 가치 있게 여기는 많은 것들을 파괴할 것이다.[54] 에드먼드 버크는 "살아있는 사람들, 죽은 사람들, 그리고 태어날 사람들과의 파트너십"에 대해 썼다.[55] 과거 세대에 대한 인류의 빚을 진지하게 받아들인다면, Ord는 그것을 갚는 가장 좋은 방법은 "미래를 위해 지불"하고 인류의 유산이 미래 세대에게 전달되도록 하는 것일 수 있다고 주장한다.

전 세계적 재앙 위험의 중요성에 대해 논의한 몇몇 경제학자들이 있다. 예를 들어, 마틴 바이트스만은 기후 변화로 인한 예상 경제적 피해의 대부분은 온난화가 중간 범위를 크게 초과하여 재앙적인 피해를 초래할 가능성이 작기 때문이라고 주장한다.[56] 리처드 포스너는 인류가 일반적으로 작고 추정하기 어려운 대규모 재앙의 위험에 대해 너무 적은 일을 하고 있다고 주장한다.[57]

7. 2. 기술 낙관론 vs. 비관론

멸망 반대 시위에서 옴니사이드에 반대하는 플래카드가 প্রদর্শিত되었다(2018)."실존적 위험"은 인류의 멸망을 초래하거나 인류의 진보를 영구적으로 저해함으로써 인류의 전체 미래를 위협하는 위험을 의미한다. 여러 학자들은 "우주의 유산"의 크기를 바탕으로, 잠재적인 미래의 삶이 상상할 수 없을 정도로 많기 때문에 실존적 위험의 작은 감소조차도 큰 가치를 지닌다고 주장해 왔다.

인류 멸망의 윤리에 대한 가장 초기의 논의 중 하나에서, 데릭 파핏은 다음과 같은 사고 실험을 제시하였다.[43]

{{Cquote

| quote = 나는 우리가 현재 할 수 있듯이 인류를 파괴한다면 이 결과가 대부분의 사람들이 생각하는 것보다 훨씬 더 나쁠 것이라고 믿는다. 세 가지 결과를 비교해 보자:

(1) 평화.

(2) 세계 인구의 99%를 죽이는 핵전쟁.

(3) 100%를 죽이는 핵전쟁.

(2)는 (1)보다 나쁠 것이고, (3)은 (2)보다 나쁠 것이다. 이 두 차이 중 어떤 것이 더 큰가? 대부분의 사람들은 더 큰 차이는 (1)과 (2) 사이의 차이라고 믿는다. 나는 (2)와 (3) 사이의 차이가 훨씬 더 크다고 믿는다.

| author = 데릭 파핏

| source =

}}

실존적 재앙에서 잃는 것의 규모는 인류의 장기적인 잠재력, 즉 인류가 생존한다면 달성할 수 있는 것에 의해 결정된다. 공리주의적 관점에서 인류를 보호하는 가치는 그 지속 기간(인류가 얼마나 오래 생존하는지), 그 규모(시간이 지남에 따라 얼마나 많은 인류가 존재하는지), 그리고 그 질(평균적으로 미래의 사람들에게 삶이 얼마나 좋은지)의 곱이다.[44] 평균적으로 종은 멸종하기 전에 약 백만 년 동안 생존한다. 파핏은 지구가 약 10억 년 동안 거주 가능할 것이라고 지적한다.[43] 그리고 이것들은 우리의 잠재력에 대한 하한일 수 있다. 만약 인류가 우주 식민지화를 통해 지구 밖으로 확장할 수 있다면, 인류의 인구를 크게 늘리고 수조 년 동안 생존할 수 있을 것이다.[45] 인류가 멸종될 경우 잃게 될 잠재력의 규모는 매우 크다. 따라서 실존적 위험을 조금이라도 줄이는 것은 매우 중요한 도덕적 가치를 지닐 것이다.[46]

칼 세이건은 1983년에 다음과 같이 썼다. "만약 우리가 멸종을 수치로 나타내야 한다면, 나는 미래 세대에서 태어나지 못할 사람들의 수를 반드시 포함할 것이다... (어떤 계산에 따르면), 위험은 '단지' 수억 명의 사람들을 죽이는 핵전쟁보다 멸종에 대해 백만 배 더 크다. 잠재적 손실에 대한 다른 많은 가능한 척도들이 있는데, 여기에는 문화와 과학, 지구의 진화적 역사, 그리고 그들의 후손의 미래에 기여한 모든 조상들의 삶의 중요성이 포함된다. 멸종은 인간의 사업을 무효화하는 것이다."[47]

철학자 로버트 메리휴 아담스는 1989년에 파핏의 "비인격적" 견해를 거부했지만, 대신 "광대한 프로젝트로서의 인류의 미래"에 대한 충성과 헌신에 대한 도덕적 명령에 대해 이야기했다. "더 나은 사회, 즉 더 정의롭고, 더 보람 있고, 더 평화로운 사회에 대한 열망... 우리의 자녀와 손자들의 삶에 대한 우리의 관심, 그리고 그들이 차례로 그들의 자녀와 손자들의 삶을 프로젝트로 삼을 수 있기를 바라는 희망."[48]

철학자 닉 보스트롬은 2013년에 선호 공리주의, 민주주의, 관리, 직관주의적 주장이 모두 실존적 위험을 예방하는 것이 높은 도덕적 우선순위라는 일반적인 견해로 수렴한다고 주장한다. 실존적 위험의 정확한 "나쁨의 정도"는 이러한 철학들 사이에서 다르더라도 말이다.

파핏은 "우주의 유산"의 크기를 다음과 같은 논증에서 계산할 수 있다고 주장한다. 만약 지구가 10억 년 더 거주 가능하고, 10억 명 이상의 인류를 지속적으로 부양할 수 있다면, 정상적인 수명의 1016 (또는 10,000,000,000,000,000)명의 인간의 삶의 잠재력이 있다.[49] 보스트롬은 더 나아가, 만약 우주가 비어 있다면, 우주론적 지평선은 적어도 1034 생물학적 인간 수명을 지원할 수 있으며, 만약 어떤 인간이 컴퓨터에 업로드된다면, 1054 사이버네틱 인간 수명에 해당하는 것을 지원할 수도 있다고 말한다.

일부 경제학자와 철학자들은 지수적 할인 및 인구 윤리에 대한 사람에게 영향을 미치는 관점을 포함한 견해를 옹호해 왔으며, 미래의 사람들은 도덕적으로 중요하지 않거나(또는 훨씬 덜 중요하게) 여겨진다.[50] 이러한 견해는 논란의 여지가 있지만,[16][51][52] 그들은 실존적 재앙이 상상할 수 있는 최악의 일 중 하나가 될 것이라는 데 동의할 것이다. 그것은 현재 존재하는 80억 명의 삶을 단축시키고, 그들의 삶을 가치 있게 만드는 모든 것을 파괴하며, 대부분의 사람들을 심각한 고통에 빠뜨릴 것이다. 따라서 미래 세대의 가치를 제쳐두고라도, 현재 존재하는 사람들에 대한 관심에 근거하여 실존적 위험을 줄여야 할 강력한 이유가 있을 수 있다.[53]

공리주의를 넘어선 다른 도덕적 관점들은 실존적 위험을 줄이는 것의 중요성을 뒷받침한다. 실존적 재앙은 인류뿐만 아니라 모든 문화적 유물, 언어, 전통, 그리고 우리가 가치 있게 여기는 많은 것들을 파괴할 것이다.[54] 따라서 우리가 가치 있는 것들을 보호하고 소중히 여겨야 할 의무가 있다는 도덕적 관점은 이것을 피해야 할 엄청난 손실로 간주할 것이다. 과거 세대에 대한 의무에 근거한 이유도 고려할 수 있다. 예를 들어, 에드먼드 버크는 "살아있는 사람들, 죽은 사람들, 그리고 태어날 사람들과의 파트너십"에 대해 쓴다.[55] 만약 과거 세대에 대한 인류의 빚을 진지하게 받아들인다면, Ord는 그것을 갚는 가장 좋은 방법은 "미래를 위해 지불"하고 인류의 유산이 미래 세대에게 전달되도록 하는 것일 수 있다고 주장한다.

전 세계적 재앙 위험의 중요성에 대해 논의한 몇몇 경제학자들이 있다. 예를 들어, 마틴 바이트스만은 기후 변화로 인한 예상 경제적 피해의 대부분은 온난화가 중간 범위를 크게 초과하여 재앙적인 피해를 초래할 가능성이 작기 때문이라고 주장한다.[56] 리처드 포스너는 인류가 일반적으로 작고 추정하기 어려운 대규모 재앙의 위험에 대해 너무 적은 일을 하고 있다고 주장한다.[57]

7. 3. 성장 중심주의 vs. 탈성장주의

멸망 반대 시위에서 옴니사이드에 반대하는 플래카드가 2018년에 등장했다. 인류의 멸망을 초래하거나 인류의 진보를 영구적으로 저해하는 "실존적 위험"은 인류 전체의 미래를 위협한다. 여러 학자들은 "우주의 유산"의 크기를 바탕으로, 잠재적인 미래의 삶이 상상할 수 없을 정도로 많기 때문에 실존적 위험의 작은 감소조차도 큰 가치를 지닌다고 주장한다.칼 세이건은 1983년에 멸종을 수치로 나타낼 때 미래 세대에서 태어나지 못할 사람들의 수를 포함해야 한다고 주장했다.[47] 그는 핵전쟁보다 멸종이 백만 배 더 큰 위험을 초래한다고 보았다. 철학자 로버트 메리휴 아담스는 1989년에 "광대한 프로젝트로서의 인류의 미래"에 대한 충성과 헌신에 대한 도덕적 명령을 강조했다.[48]

닉 보스트롬은 2013년에 선호 공리주의, 민주주의, 관리, 직관주의적 주장이 모두 실존적 위험을 예방하는 것이 높은 도덕적 우선순위라는 견해로 수렴한다고 주장했다. 데릭 파핏은 지구가 10억 년 더 거주 가능하고 10억 명 이상의 인류를 지속적으로 부양할 수 있다면, 10명의 인간의 삶의 잠재력이 있다고 주장했다.[49] 보스트롬은 우주가 비어 있다면, 우주론적 지평선은 10 사이버네틱 인간 수명에 해당하는 것을 지원할 수도 있다고 보았다.

지수적 할인 및 인구 윤리에 대한 사람에게 영향을 미치는 관점을 옹호하는 일부 경제학자와 철학자들은 미래의 사람들이 도덕적으로 중요하지 않거나 덜 중요하다고 여긴다.[50] 그러나 이들은 실존적 재앙이 현재 존재하는 사람들의 삶을 단축시키고 가치를 파괴하며 고통을 초래할 것이라는 점에 동의한다.[53]

공리주의를 넘어선 다른 도덕적 관점들도 실존적 위험 감소의 중요성을 뒷받침한다. 실존적 재앙은 문화적 유물, 언어, 전통 등 가치 있는 것들을 파괴할 것이다.[54] 에드먼드 버크는 "살아있는 사람들, 죽은 사람들, 그리고 태어날 사람들과의 파트너십"을 언급하며 과거 세대에 대한 의무를 강조했다.[55]

마틴 바이트스만은 기후 변화로 인한 예상 경제적 피해의 대부분은 온난화가 중간 범위를 크게 초과하여 재앙적인 피해를 초래할 가능성이 작기 때문이라고 주장했다.[56] 리처드 포스너는 인류가 일반적으로 작고 추정하기 어려운 대규모 재앙의 위험에 대해 너무 적은 일을 하고 있다고 주장했다.[57]

8. 결론

참조

[1]

웹사이트

The grim fate that could be 'worse than extinction'

https://www.bbc.com/[...]

2020-11-11

[2]

논문

An upper bound for the background rate of human extinction

2019-07-30

[3]

서적

The Annotated Origin

Harvard University Press

2009

[4]

서적

The Arch-heretic Marcion

https://books.google[...]

Mohr Siebeck

2023-06-11

[5]

서적

Politics of Religion/Religions of Politics

https://books.google[...]

Springer Netherlands

2023-06-11

[6]

서적

X-Risk: How Humanity Discovered Its Own Extinction

https://books.google[...]

MIT Press

2022-10-19

[7]

서적

Tempo And Mode in Evolution: Genetics And Paleontology 50 Years After Simpson

National Academies Press (US)

[8]

웹사이트

The Bomb and Civilization

http://www.personal.[...]

1945

[9]

논문

The Polls: Atomic Weapons and Nuclear Energy

https://www.jstor.or[...]

1963

[10]

뉴스

Nuclear War and Climatic Catastrophe: Some Policy Implications

https://www.foreigna[...]

2021-08-11

[11]

서적

Our Final Hour: A Scientist's Warning: How Terror, Error, and Environmental Disaster Threaten Humankind's Future In This Century – On Earth and Beyond

Basic Books

[12]

서적

Global catastrophic risks

Oxford University Press

[13]

서적

The Precipice: Existential Risk and the Future of Humanity

Hachette

2020

[14]

논문

Global Catastrophic Risks Survey

https://www.fhi.ox.a[...]

Future of Humanity Institute

2008

[15]

웹사이트

Frequently Asked Questions

http://existential-r[...]

Future of Humanity Institute

2013-07-26

[16]

논문

Reducing the Risk of Human Extinction

http://users.physics[...]

2016-07-01

[17]

논문

Earth in the cosmic shooting gallery

http://www.arm.ac.uk[...]

[18]

논문

Super eruptions as a threat to civilizations on Earth-like planets

http://www.eos.ubc.c[...]

2022-02-14

[19]

논문

Subdecadal phytolith and charcoal records from Lake Malawi, East Africa imply minimal effects on human evolution from the ~74 ka Toba supereruption

2018-03-01

[20]

서적

Pale Blue Dot

Random House

1994

[21]

서적

On What Matters Vol. 2

Oxford University Press

2011

[22]

논문

Potential incompatibility of inherited behavior patterns with civilization: Implications for Fermi paradox

2024

[23]

논문

Probabilities, methodologies and the evidence base in existential risk assessments

http://eprints.lse.a[...]

2018-08-26

[24]

서적

Implications of the Copernican principle for our future prospects

[25]

서적

Our Final Century

Arrow Books

[26]

웹사이트

Human Extinction Isn't That Unlikely

https://www.theatlan[...]

Emerson Collective

2016-04-30

[27]

간행물

When Will AI Exceed Human Performance? Evidence from AI Experts

2018-05-03

[28]

웹사이트

Is the AI apocalypse actually coming? What life could look like if robots take over

https://www.standard[...]

2023-05-31

[29]

간행물

How Close Is Humanity to the Edge?

https://www.newyorke[...]

2021-01-08

[30]

뉴스

What are the chances of an AI apocalypse?

https://www.economis[...]

2023-07-10

[31]

웹사이트

A 30% Chance of AI Catastrophe: Samotsvety's Forecasts on AI Risks and the Impact of a Strong AI Treaty

https://taisc.org/re[...]

2023-05-01

[32]

웹사이트

Will humans become extinct by 2100?

https://www.metaculu[...]

2024-03-26

[33]

웹사이트

Global Existential Risks

https://www.aei.org/[...]

2024-12-17

[34]

웹사이트

Humans will be extinct in 100 years says eminent scientist

https://phys.org/new[...]

2021-01-10

[35]

웹사이트

Theoretical Physicists Say 90% Chance of Societal Collapse Within Several Decades

https://www.vice.com[...]

2020-07-28

[36]

논문

Deforestation and world population sustainability: a quantitative analysis

2020

[37]

간행물

Existential Risks: Analyzing Human Extinction Scenarios and Related Hazards

2002

[38]

논문

Implication of our technological species being first and early

2017-08-03

[39]

논문

Human extinction by asteroid impact

2022-04

[40]

웹사이트

Practical application

http://www.princeton[...]

2005-05-12

[41]

서적

Apocalypse when?

Praxis

[42]

논문

A singular chain of events

[43]

서적

Reasons and Persons

Oxford University Press

1984

[44]

웹사이트

Population Ethics {{!}} Practical Implications of Population Ethical Theories

https://www.utilitar[...]

2021

[45]

논문

Astronomical Waste: The opportunity cost of delayed technological development

http://www.nickbostr[...]

[46]

웹사이트

The case for reducing existential risks

https://80000hours.o[...]

2020-01-08

[47]

논문

Nuclear war and climatic catastrophe: Some policy implications

https://www.research[...]

1983

[48]

논문

Should Ethics be More Impersonal? a Critical Notice of Derek Parfit, Reasons and Persons

1989-10

[49]

간행물

Reasons and Persons

Clarendon Press

1984

[50]

논문

Moral Problems of Population

1973

[51]

논문

Discounting for Public Policy: A Survey

https://www.cambridg[...]

2017

[52]

논문

Population axiology

https://onlinelibrar[...]

2017

[53]

웹사이트

The person-affecting value of existential risk reduction

https://gregoryjlewi[...]

2020-08-07

[54]

간행물

Nuclear War and Climatic Catastrophe: Some Policy Implications

https://www.foreigna[...]

Council on Foreign Relations

1983

[55]

서적

Select Works of Edmund Burke Volume 2

Liberty Fund

[56]

논문

On modeling and interpreting the economics of catastrophic climate change

http://dash.harvard.[...]

2009

[57]

서적

Catastrophe: Risk and Response

Oxford University Press

2004

[58]

서적

Better Never to Have Been: The Harm of Coming into Existence

https://archive.org/[...]

Oxford University Press

2008

[59]

서적

Better Never to Have Been: The Harm of Coming into Existence

https://archive.org/[...]

Oxford University Press

2008

[60]

서적

The Politics of Total Liberation: Revolution for the 21st Century

Palgrave Macmillan

2014

[61]

뉴스

Would Human Extinction Be a Tragedy?

https://www.nytimes.[...]

2018-12-17

[62]

서적

The Ahuman Manifesto: Activism for the End of the Anthropocene

Bloomsbury Academic

2020

[63]

논문

Review of The Last Man, Jean-Baptiste François Xavier Cousin de Grainville

https://www.jstor.or[...]

2003

[64]

뉴스

He imagines a world without people. But why?

http://archive.bosto[...]

2016-07-20

[65]

뉴스

Depopulation Boom

https://www.washingt[...]

2016-07-20

[66]

서적

The end: 50 apocalyptic visions from pop culture that you should know about – before it's too late

Zest Books

2012

[67]

서적

Technophobia!: science fiction visions of posthuman technology

University of Texas press

2005

[68]

간행물

Existential risk prevention as global priority

2013

[69]

뉴스

Human race 'will be extinct within 100 years', claims leading scientist

http://www.dailymail[...]

2010-06-18

[70]

논문

Existential Risks

http://www.jetpress.[...]

2002-03

[71]

간행물

How can we reduce the risk of human extinction?

http://thebulletin.o[...]

2014-01-28

[72]

뉴스

Top U.S. Disease Fighters Warn of New Engineered Pathogens but Call Bioweapons Doomsday Unlikely

http://www.nti.org/g[...]

2013-09-10

[73]

웹사이트

graph of day carbon emissions and human

http://www.desdemona[...]

[74]

간행물

Quaternary climatic instability in south-east Australia from a multi-proxy speleothem record

2014

[75]

문서

Bostrom 2002, section 4.10

[76]

뉴스

The Super-Duper, Planet-Frying, Exploding Star That's Not Going to Hurt Us, So Please Stop Worrying About It

http://science.time.[...]

Time Magazine

2012-12-21

[77]

웹사이트

WR 104: Technical Questions

http://www.physics.u[...]

2015-12-20

[78]

간행물

The Near-Earth Objects and Their Potential Threat To Our Planet

https://www.research[...]

2013

[79]

간행물

Experimental evidence that an asteroid impact led to the extinction of many species 65 million years ago

1983-01

[80]

간행물

Carbon dioxide toxicity and climate change: a serious unapprehended risk for human health.

http://grapevine.com[...]

[81]

문서

Vitousek, P. M., H. A. Mooney, J. Lubchenco, and J. M. Melillo. 1997. Human Domination of Earth's Ecosystems. Science 277 (5325): 494–499; Pimm, S. L. 2001. The World According to Pimm: a Scientist Audits the Earth. McGraw-Hill, NY; The Guardian. 2005. Earth is All Out of New Farmland. 7 December 2005.

[82]

웹사이트

Human Population Growth and Extinction

http://www.biologica[...]

2018-03-30

[83]

뉴스

Can we be sure the world's population will stop rising?

https://www.bbc.co.u[...]

BBC News

2012-10-13

[84]

Youtube

The best stats you've ever seen

http://www.ted.com/t[...]

TED Talks

[85]

서적

Energy for a Sustainable World: From the Oil Age to a Sun-Powered Future

https://books.google[...]

John Wiley & Sons

[86]

뉴스

Date set for desert Earth

http://news.bbc.co.u[...]

BBC News

2014-01-28

[87]

웹사이트

Earth's Final Sunset Predicted

http://www.space.com[...]

space.com

2014-01-28

[88]

간행물

Distant future of the Sun and Earth revisited

[89]

간행물

Existential Risks

http://www.jetpress.[...]

2014-01-28

[90]

간행물

The singularity: A philosophical analysis

http://consc.net/pap[...]

2013-08-17

[91]

서적

OUR FINAL HOUR: A Scientist's warning: How Terror, Error, and Environmental Disaster Threaten Humankind's Future in This Century — On Earth and Beyond

2004

[92]

문서

Bostrom 2002, section 4.8

[93]

웹사이트

A black hole ate my planet

https://www.newscien[...]

New Scientist

2019-04-30

[94]

웹사이트

Statement by the Executive Committee of the DPF on the Safety of Collisions at the Large Hadron Collider.

http://www.aps.org/u[...]

[95]

웹사이트

Humans are still evolving: 3 examples of recent adaptations

https://www.inverse.[...]

2023-08-08

[96]

웹사이트

Forearm artery reveals human evolution continues

http://news.flinders[...]

2023-08-08

[97]

웹사이트

EmTech: Get Ready for a New Human Species

https://www.technolo[...]

2016-07-01

[98]

서적

Thomas Aquinas : teacher of humanity : proceedings from the first conference of the Pontifical Academy of St. Thomas Aquinas held in the United States of America

https://books.google[...]

2015-10-05

[99]

서적

Perspectives on Health and Human Rights

https://books.google[...]

2016-07-01

[100]

서적

Posthuman Suffering and the Technological Embrace

https://books.google[...]

2016-07-01

[101]

웹사이트

The Transhuman Future: Be More Than You Can Be

https://www.npr.org/[...]

2016-07-01

[102]

웹사이트

WILL YOU JOIN THE TRANSHUMAN EVOLUTION?

http://www.dld-confe[...]

2016-07-01

[103]

웹사이트

How humans are turning into a 'totally different species'

http://www.techinsid[...]

2016-07-01

[104]

서적

I, Cyborg

University of Illinois Press

2004

[105]

웹사이트

Is technology causing us to 'evolve' into a new SPECIES? Expert believes super humans called Homo optimus will talk to machines and be 'digitally immortal' by 2050

http://www.dailymail[...]

DailyMail Online

2016-07-01

[106]

논문

Mutation and Human Exceptionalism: Our Future Genetic Load

2016-03-01

[107]

웹사이트

Existential Risks - Analyzing Human Extinction Scenarios and Related Hazards

http://www.nickbostr[...]

2019-04-30

[108]

문서

"Practical application" page 39 of the Princeton University paper: Philosophical Implications of Inflationary Cosmology

http://www.princeton[...]

2005-05-12

[109]

문서

Existential risk prevention as global priority

http://www.existenti[...]

2013

[110]

문서

Reducing the risk of human extinction

http://users.physics[...]

2007

[111]

서적

Apocalypse when?

Praxis

2009

[112]

문서

Reducing the risk of human extinction

http://users.physics[...]

2007

[113]

문서

A singular chain of events

http://papers.ssrn.c[...]

2009

[114]

문서

Existential risk prevention as global priority

http://www.existenti[...]

2013

[115]

문서

Cognitive biases potentially affecting judgment of global risks

https://intelligence[...]

2008

[116]

웹사이트

We're Underestimating the Risk of Human Extinction

https://www.theatlan[...]

The Atlantic

2016-07-01

[117]

서적

Soviet Marxism and nuclear war : an international debate : from the proceedings of the special colloquium of the XVth World Congress of Philosophy

Greenwood Press

1981

[118]

서적

Omnicide: The Nuclear Dilemma

Praeger

1990

[119]

서적

Confronting Omnicide: Jewish Reflections on Weapons of Mass Destruction

Jason Aronson, Inc

1991

[120]

문서

The Ecology of Hope: Environmental Grassroots Activism in Japan

https://www.research[...]

Union Institute & University, College of Graduate Studies

2004

[121]

논문

A Seminal Work on Genocide

2006

[122]

논문

Genocide, Nuclear Omnicide, and Individual Responsibility

1987

[123]

웹사이트

Stephen Hawking: Humanity Must Colonize Space to Survive

http://www.space.com[...]

2016-07-01

[124]

웹사이트

Hawking: Humans at risk of lethal 'own goal'

https://www.bbc.com/[...]

BBC

2016-07-01

[125]

문서

Reducing the risk of human extinction

http://users.physics[...]

2007

[126]

서적

Apocalypse when?

Praxis

2009

[127]

문서

Catastrophe, social collapse, and human extinction

https://mason.gmu.ed[...]

2008

[128]

뉴스

He imagines a world without people. But why?

http://archive.bosto[...]

2016-07-20

[129]

뉴스

Depopulation Boom

https://www.washingt[...]

2016-07-20

[130]

서적

The end: 50 apocalyptic visions from pop culture that you should know about -- before it's too late

Zest Books

2012

[131]

서적

Technophobia!: science fiction visions of posthuman technology

University of Texas press

2005

[132]

뉴스

Human race 'will be extinct within 100 years', claims leading scientist

http://www.dailymail[...]

2014-01-28

[133]

문서

Existential risk prevention as global priority

http://www.existenti[...]

2013

본 사이트는 AI가 위키백과와 뉴스 기사,정부 간행물,학술 논문등을 바탕으로 정보를 가공하여 제공하는 백과사전형 서비스입니다.

모든 문서는 AI에 의해 자동 생성되며, CC BY-SA 4.0 라이선스에 따라 이용할 수 있습니다.

하지만, 위키백과나 뉴스 기사 자체에 오류, 부정확한 정보, 또는 가짜 뉴스가 포함될 수 있으며, AI는 이러한 내용을 완벽하게 걸러내지 못할 수 있습니다.

따라서 제공되는 정보에 일부 오류나 편향이 있을 수 있으므로, 중요한 정보는 반드시 다른 출처를 통해 교차 검증하시기 바랍니다.

문의하기 : help@durumis.com